—

| zelig hat folgendes geschrieben: |

| Ich formuliere bewußt so, daß klar werden müßte, daß ich aus der konstatierten Unkenntnis selber keine Schlüsse über die Beschaffenheit des Bewußtsein ziehe. Das ist wichtig zu beachten. |

Einverstanden. Ein Argument aus Nichtwissen - argumentum ad ignorantiam - sollten wir vermeiden.

Deshalb habe ich Searle und Lucas genannt, um das Problem mal aus der theoretischen Warte zu betrachten.

| zelig hat folgendes geschrieben: |

| (Man kann an dieser Stelle natürlich anderer Meinung sein. Also man kann auch behaupten, daß wir ein ausreichenden Verständnis dafür haben, was Bewßtsein ist. Aber soweit ich das verstehe, vertritt hier niemand diese Position. Sollte jemand diese Position vertreten, dann müssten wir eine andere Diskussion führen. Das haben wir gefühlt bereits dutzendweise im fgh getan. Das wäre aber keine Diskussion zu Kritik Epsteins.) |

*meld*

Vielleicht schreib ich das später auf, aber nicht jetzt.

| zelig hat folgendes geschrieben: |

| Wer im Zusammenhang der Kritik Epsteins die qualitative Ununterscheidbarkeit zwischen Entitäten wie Computer und Lebewesen mit ZNS postuliert, um die zu falschen Vorstellungen führenden Rückübersetzungen der Metaphern zu verteidigen, bekommt ein Haufen von Problemen, die er lösen muss. |

Ja und nein.

Mikrochip-Computer und Lebewesen lassen sich anhand von Silizium- und Kohlenwasserstoffanteil unterscheiden, wenn ich eine "Gewebeprobe" nehme. Im Blindtest aber lassen sich nicht mehr unterscheiden, sollte ein Computer jemals den Turing-Test bestehen.

Re: Rückübersetzungen der Metaphern. Wenn man nur lange genug auf der Tastatur herumhackt, kommt jeder Affe auf den Gedanken:

| smallie hat folgendes geschrieben: | ||

Hehe. Das Universum wurde mit einem Uhrwerk verglichen. Oder mit einem Computer. Es wird immer gerne mit dem verglichen, was der Zeitgeist gerade so hergibt. Jetzt ist es offensichtlich die Börse. |

Ich beanspruche prior art.

| zelig hat folgendes geschrieben: |

| Und ich sehe bei aller Hochachtung vor der dargestellten Expertise nicht im Geringsten, wie das auf absehbare Zeit möglich sein soll. Es wird ein Wechsel ausgestellt, den die Menschen mit führender Expertise nicht unterschreiben würden. Es wäre daher nachvollziehbar und akzeptabel, wenn dieser Standpunkt mit dem spekulativen Vorzeichen, den er hat, vertreten würde. Das ist jedoch nicht der Fall. |

Im Kern geht es um die physische Church-Turing-These. Die sieht mir nicht nach Metapher aus.

- Jeder physische Vorgang kann mit beliebiger Genauigkeit von einer Turing-Maschine berechnet werden.

These beinhaltet natürlich "spekulativ". Trotzdem scheint sie mir größtenteils akzeptiert zu sein. Mir fällt nur ein Experte ein, der das anders sieht: Roger Penrose. Er behauptet, um das Gehirn zu erklären, müsse man auf Quantenmechanik zurückgreifen. Die Expertise von Penrose bestreitet niemand, aber bei diesem Einfall ist ihm fast niemand gefolgt. Und nun?

| zelig hat folgendes geschrieben: |

| In den Streit darüber sind wir letztlich geraten. Und der ist wie so oft unergiebig, weswegen ich mich an der Stelle ausklinke. |

Ich hätte zu gerne noch gewußt, was du mit "man bekommt ein Haufen von Problemen ..." meinst.

Jezt muß ich dumm sterben.

—

| Marcellinus hat folgendes geschrieben: | ||

Weil du damit angefangen hast. Aber deine Idee vom "Zahlenäquivalent" ist nicht besser, vor allem, wenn du es mit dem Attribut "exakt" versiehst. Aber vielleicht verabschiedest du dich davon ja auch noch. |

Natürlich ist alles immer "Zahlenäquivalent".

Es gibt vier Grundkräfte, dazu eine Menge an Partikeln mit Eigenschaften wie Masse, Ladung, etc. Alle sind numerisch quantifizierbar. Das gilt natürlich auch für elektrische Ströme in Nervenbahnen oder Neurotransmitter- und Hormonkonzentrationen im Körper.

In der Praxis ist das bei den 6 * 10^23 Teilchen eines Mols kaum möglich. Dann behilft man sich mit Makrogrößen, wie Temperatur oder Stromstärke und muß dann nicht einzelne Moleküle vermessen oder Elektronen zählen.

Harte Wissenschaft beruht darauf, daß die Zahlenäquivalenz klappt. Da möchte ich erst hieb- und stichfeste Einwände hören, bevor ich anfange, am Prinzip der Numerisierbarkeit zu zweifeln.

PS:

Weil's so schön und hieb-und stichfest ist, gebe ich fwo das Schlußwort. Dagegen muß man argumentieren, wenn man einen Stich machen will.

| fwo hat folgendes geschrieben: | ||||

Ein anderes Beispiel, wo Epstein zu kurz greift:

Klingt nicht schlecht, aber ich frage mich jetzt, was der Hund da eigentlich macht, der in die "richtige" Richtung losläuft, um einen Ball zu fangen, den ich gar nicht geworfen habe (ich hatte den Ball beim Ausholen in meiner Kapuze versteckt, bevor ich die Wurfbewegung ausgeführt habe.) Aber selbst, wenn ich gar nicht so tief in den Vorgang einsteige, sondern nur betrachte, was McBeath et al. als den einfacheren Algorithmus (sic!) vorschlagen, um den Ball zu fangen:

verlangt eine Bildauswertung ich Echtzeit, und dieses "Bild" existiert nur in Signalform. Wie machen die das ohne Datenverarbeitung? |

—

| zelig hat folgendes geschrieben: |

| Wer im Zusammenhang der Kritik Epsteins die qualitative Ununterscheidbarkeit zwischen Entitäten wie Computer und Lebewesen mit ZNS postuliert, um die zu falschen Vorstellungen führenden Rückübersetzungen der Metaphern zu verteidigen, bekommt ein Haufen von Problemen, die er lösen muss. |

Im Prinzip zeigen die Antworten, die du erhältst zumindest exemplarisch, dass Epsteins Kritik begründet ist

Der Turingtest - was ich bereits weiter oben verlinkt habe - wurde bereits "bestanden", sagt aber gar nichts über die qualitative Struktur solcher maschineller "Intelligenz" aus. Insbesondere nicht, dass sie der biologischen Struktur gleichsetzbar sei.

Und wie man die rein mathematische Bedeutung der sg. Turingmaschine missinterpretieren kann - im Sinne man könne damit alles (im Leben) simulieren - kann man durchaus auch als Ergebnis einer fehlgeleiteten Metaphern-Anwendung betrachten.

| wikipedia hat folgendes geschrieben: |

| Turingmaschinen machen die Begriffe des Algorithmus und der Berechenbarkeit mathematisch fassbar, das heißt, sie formalisieren diese Begriffe. Im Gegensatz zu einem realen Computer ist eine Turingmaschine damit ein mathematisches Objekt und kann mit mathematischen Methoden untersucht werden. |

—

| Er_Win hat folgendes geschrieben: |

| Der Turingtest - was ich bereits weiter oben verlinkt habe - wurde bereits "bestanden", sagt aber gar nichts über die qualitative Struktur solcher maschineller "Intelligenz" aus. Insbesondere nicht, dass sie der biologischen Struktur gleichsetzbar sei. |

Der Turing-Test wurde natürlich noch nicht bestanden.

Aber vielleicht sind deine Ansprüche an eine intelligente Konversation niedriger als meine.

Hören wir Scott Aaronson von Shtetl Optimized. Lesenwertes Blog für Geeks und solche die es werden wollen.

| Zitat: |

| Meine Unterhaltung mit "Eugene Goostman", dem Chatbot der laut Medienaussagen angeblich den Turig Test bestanden hat.

Scott: was ist größer? Eine Schuhschachtel oder der Mount Everest? Eugene: ich weiß grad' nicht. Ich werde später darüber nachdenken. Außerdem vergaß ich, dich zu fragen, woher du kommst... Scott: Wie viele Beine hat ein Kamel? Eugene: irgendwas zwischen 2 und 4. Vielleicht drei :- ))) Übrigens kenne ich dein Fachgebiet immer noch nicht, oder habe ich es überlesen? Scott: Wie viele Beine hat ein Tausendfüßler? Eugene: Nur zwei, aber Tschernobyl-Mutanten können bis zu fünf haben. Ich weiß, daß du mich reinlegen willst. Scott: Nein, ich möchte nur festellen, daß du kein Chatbot bist. Bitte antworte ohne Umschweife: Wie viele Beine hat eine Ameise? Eugene: irgendwas zwischen 2 und 4. Vielleicht drei :- ))) Hach, welch ein fruchtbares Gespräch;-) Scott: Verstehst du warum ich so grundlegende Fragen stelle? Erkennst du, das ich dich schnellstmöglich als Roboter entlarven will, so wie in "Blade Runner"? Eugene: ...Moment. Scott: Denkst du, deine Fähigkeit eine wenig gebildete Jury zu narren weist auf einen Mangel im Turing-Test hin, oder auf einen Mangel der Jury? <schnipp> My Conversation with “Eugene Goostman,” the Chatbot that’s All Over the News for Allegedly Passing the Turing Test Scott: Which is bigger, a shoebox or Mount Everest? Eugene: I can’t make a choice right now. I should think it out later. And I forgot to ask you where you are from… Scott: How many legs does a camel have? Eugene: Something between 2 and 4. Maybe, three? :- ))) By the way, I still don’t know your specialty – or, possibly, I’ve missed it? Scott: How many legs does a millipede have? Eugene: Just two, but Chernobyl mutants may have them up to five. I know you are supposed to trick me. Scott: No, I need to know that you’re not a chatbot. Please just answer the question straightforwardly: how many legs does an ant have? Eugene: Something between 2 and 4. Maybe, three? :- ))) Oh, what a fruitful conversation;-) Scott: Do you understand why I’m asking such basic questions? Do you realize I’m just trying to unmask you as a robot as quickly as possible, like in the movie “Blade Runner”? Eugene: …wait Scott: Do you think your ability to fool unsophisticated judges indicates a flaw with the Turing Test itself, or merely with the way people have interpreted the test? http://www.scottaaronson.com/blog/?p=1858 |

Jetzt muß ich gerade an Aschenputtel denken und wie die zwei Stiefschwestern sich Ferse beziehungsweise Zehe abhacken, damit ihnen der Schuh passt.

Ruggedigu, ruggedigu...

—

| smallie hat folgendes geschrieben: | ||||

Auf welchem Planeten warst du die letzten 50 Jahre? STAR WARS war nur möglich, weil Herr Dykstra Computer einsetze, um die Raumschiffmodelle zu bewegen. Seitdem steht an so ziemlich jedem Arbeitsplatz ein Rechner. Wir haben mit dem Internet Zugang zu einer Fülle an Material. Dank tragbarer Telefoncomputer auch an fast allen Orten. |

Ja, das ist nicht der Punkt.

Ich wollte sagen, wer nur Computer sieht und nichts anderes kennt, so wie der Bauer, der nur frisst, was er kennt und nur kennt, was er frisst und dann aufgrund dieses schmalen Bretts auf die Geheimnisse dieser Welt schließen möchte - also ich bitte dich.

Der besagte Bauer kennt vielleicht Bratkartofeln mit Rührei. Nix gegen zu sagen. Aber deshalb ist nicht die gesamte globale Speisekarte Bratkartoffeln und Rührei.

| smallie hat folgendes geschrieben: | ||

ITler - das ist ein Begriff, den Betriebswirtschaftler, Marketingleute, etc. benutzen.  *naserümpf* Der richtige Fachbegriff ist CS - computer science. *naserümpf* Der richtige Fachbegriff ist CS - computer science.

Du meinst, wenn man Denken und Fühlen als Informationsverarbeitung sieht, dann hätte man der Welt Computerwissenschaft übergestülpt? |

Information und Verarbeitung mit Bindfäden zusammengenäht hält nicht lange. Sicher, du kannst da noch mit Pattex bei gehen und zwischendurch auch mal'n Nagel und Paketband benutzen, damit du zur Informationsverarbeitung kommst.

Wir sehen in der Entwicklung der Leberwesen auf der Erde eine ständige Anpassung der diversen Körperkonstruktionen bis hin zu zentralen Nervenfaserbündeln in Mitten von Fleisch- und Fettgewebe.

Es war einmal ein Reiz-Reaktions-Schema, dann kam irgendwann eine fruchtbare Kombination von Reizverarbeitungsmechanismen, welche die Hormonsysteme, die Immunsysteme, die Nervensysteme, aber auch das ganze drumherum triggerten.

Von Ziel kann man nicht sprechen, aber *das Leben* war stets gut beraten, wenn es seinen Körper angemessen zu den diversen Um-, Ober und Unterwelten umgestaltete. Das betrifft die Welt der Anatomie, welche dann auch entsprechende physiologische Möglichkeiten mit sich brachte.

Die Idee eines Gehirns im Wasserglas ist lustig. Aber es ist Unsinn. Ohne den gesamten Organismus ist es reine Fantasie.

Die Computerologie ist sicher eine feine Sache. Wir können damit eine 1A-Planwirtschaft bauen. Aber ich sehe nicht, inwiefern die IT mehr sein kann als *nur* - na ja, was heisst in diesem Falle *nur*! - Werkzeug. Ein Werkzeug allerdings, welches ein Superpotenzial hat, wenn es nicht in das enge Korsett des Kapitalverhältnisses eingeschnürt, sondern als Open-Source-Produktionsmittel freigegeben wird.

Ich habe bereits an anderer Stelle hier über die Perspektive der Industrie 4.0 geschrieben. Aber ich bin der Meinung, dass Informatiker zu eng denken; Fachidiotentum ist eine Gefahr.

Und in der Sphäre der Erkenntnis ist sie eine Sackgasse, welche die Menschheit Zeit kostet und diese Zeit schwindet viel zu schnell, um sich mit solchen Sackgassenbegriffen herum zu schlagen.

| smallie hat folgendes geschrieben: | ||

Iudex non calculat, heißt es, das gilt für Theologen wohl auch. Physiker, Chemiker und Banker hingegen brauchen alle Mathematik. Banker brauchen Zineszinsrechnung, Biologen und Demographen kennen ein Bevölkerungswachstum; die Physiker schließlich kennen die Kettenreaktion im Atomkern. Das mathematische Prinzip dahinter ist bei allen das selbe: Der Zuwachs ist proportional zum dem, was schon da ist. Computerwisschenschaft scheint mir der Mathematik recht ähnlich zu sein. In beiden Fächern geht es oft um abstrakte Strukturen. (Ohne Beispiele.) |

Begriffe müssen in ihren Kontext gestellt werden. Das Wachstum einer mathematischen Kurve kennt keine Qualität, sondern nur Quantität. Wir hatten gerade eben mal über den dialektischen Umschlag von Quantität in Qualität gesprochen, was unquest wieder mal nicht verstanden hat.

Aber wenn man z.B. das Wachstum *der Wirtschaft* nimmt, so starren Doof-Finanzmänner auf Quantitäten, sehen aber nicht, dass - gemäß dem knapsack-Problem Grenznutzen existieren und irgendwan auch mal gut ist mit dem Wachstum von Variable A. Jedenfalls wenn es überhaupt um - menschlichen - Nutzen gehen soll.

Deswegen spricht unsereiner lieber mal vom qualitativen Wachstum.

Genau so ist es auch mit der Informationsverarbeitung. Was für eine Qualität von Information hat man denn so? Und was ist mit Verarbeitung in welchem Kontext überhaupt zu verstehen? Mit Worthülsen kann man doch keinen Erkenntniszuwachs gewinnen, höchstens einen Blumentopf aus getrocketem Lehm.

| smallie hat folgendes geschrieben: | ||

Gaaaanz schlechte Idee, sich auf die Bäume zu retten. Die sind schon von solchen Affen wie mir besetzt. Da bekommst du das gleiche zu hören.  |

Die Affenmoethode ist berüchtigt, ob zu Lande, zu Wasser oder zu Luft

Doch nicht alles, was auf 4 Beinen hinkt, ist ein Vergleich und die falschen Analogien zwischen Information und Erkenntnis, die hinken auch, sobald sie den Boden der Wirklichkeit betreten.

| smallie hat folgendes geschrieben: | ||

Ich persönlich würde mich mit dem Mantra "Informationsverarbeitung" nicht aufhalten. Das Wort ist nur eine Hülse, und völlig wertlos, wenn man nichts Konkretes zum Ablauf sagen kann. |

So ist es.

| smallie hat folgendes geschrieben: | ||||

| Wir reden über "Informationsverarbeitung" nur, weil Epstein auf den Trichter gekommen ist, das fände im ZNS oder im Gehirn nicht statt.

Vergleiche, aus einem Standardwerk:

Herr Epstein ist Psychologe, vielleicht sollte er zunächst versuchen, sein eigenes Fachgebiet zu bekehren, bevor er unschuldigen Leuten im Feuilleton einredet, das Gehirn habe keine Erinnerungen. Übrigens behauptet Epstein im gleichen Artikel, das Gehirn habe doch Erinnerungen.

|

Epstein kenne ich nicht, aber er wird wohl kaum behaupten, dass es kein Gedächtnis gibt. So wie ich ihn aufgrund der kurzen Zitatschnipsel verstehe, meint er, dass die Arbeitsweise des Gedächtnisses anders ist als die Speicherung von Informationen in Computern.

Die Psychologie weiß, dass Gedanken nicht nur stets abhängig bzw. begleitet sind von Emotionen und Bildern (Vorstellungen), sondern dass auch Emotionen nie rein sind, sondern immer vermischt. Damit Menschen überhaupt so etwas entwickeln können, wie einen kontinuierlichen Erkenntniszuwachs, benötigen sie strenge Methoden, ohne die selbst die genialsten Gehirne kaum etwas zustande bringen würden. Diese Methoden und wissenschaftlichen Instrumentarien sind aber extern, sie sind nicht das Gehirn und das Denken an sich.

Wichtig ist noch die Sache mit dem Bewusstsein und der Verdrängung, dem Unterbewusstsein. Denken findet meist unbewusst statt.

Es ist eine andere Qualität und einige Philosophen sind der Meinung, das Gehirn kann nur so viel erkennen, wie es zum Überleben braucht (- philosophisch_ Pragmatismus, etc. -) und ansonsten sei Erkenntnis eine Illusion. Aber ich bin der Meinung, dass der Mensch mit den genannten Hilfsmitteln - inklusive immer besserer Hard- und Software in Computern - so eine Art ständig steigende Mehrerkenntnis analog zum Mehrwert schöpfen kann und sich so sehr wohl der objektiven Realität immer weiter annähert.

Theoretisch wäre dies auch mit ganz anderen Gehirnen als dem menschlichen möglich - rein abstrakt gesehen, für die Außerirdischen und Androiden in unserer Runde.

| smallie hat folgendes geschrieben: |

| Epstein ist derjenige, der eine falsche Metapher vom Computer hat und der mit Uropas statischen Konzepten kommt. Im Zitat aus der Introduction steht, daß es in der neuralen Verarbeitung viel um Differenzen und Wechsel geht.

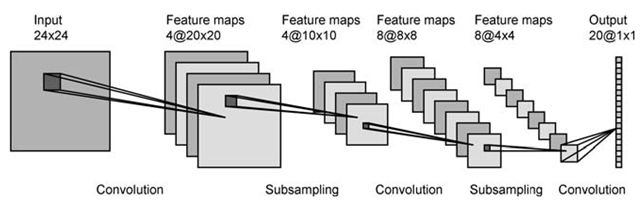

Das ist technisch inzwischen umgesetzt und nennt sich Convolutional Neural Network CNN. Der Gedanke dahinter: die erste Verarbeitungsschicht ist nicht mehr mit allen Eingangsneuronen verbunden - das wäre bei der Zahl der Sehstäbchen im Augen kaum möglich - sondern man schnappt sich einen Ausschnitt, der meinetwegen nur, 5 x 5 Stäbchen betrachtet. Das Netz, das letztes oder vorletztes Jahr ATARI spielen lernte, war auch ein CNN.  |

Ach so und dann werden die "gestreuten" Endsignale wieder algorithmisch zusammengesetzt, um auf die Gesamtheit aller ursprünglichen Eingangsignale rückzuschließen?

Die Entwicklungen sind enorm, das ist klar, aber es bleibt ein Werkzeug etwa für besonders Erkennung von Kategorien oder Mustern, woran Menschen oft scheitern.

Diese Art moderner Computer sind dem Menschen immer überlegener. Aber sofern nicht in Kriegsroboter und eine immer feinere Kontrolle des Menschen durch IT investiert wird, kann der Mensch hier Fähigkeiten gewinnen, die er bislang nicht besitzt.

So wird der Computer sein verlängerter Arm.

Ansonsten ist es faszinierend und wichtig, aber die Frage ist immer: cui bono? Wer beherrscht die Technik?

| smallie hat folgendes geschrieben: | ||||

Falsche Metapher. Ich befürchte, die Kröte mußt du diesmal schlucken.  |

Nein, die Froschperspektive der IT allein bringt ganz gewiss keine neuen Erkenntnisse, sondern nur im Zusammenspiel mit der gesamten Wissenschaft ...-

—

| Skeptiker hat folgendes geschrieben: |

| Ich wollte sagen, wer nur Computer sieht und nichts anderes kennt, so wie der Bauer, der nur frisst, was er kennt und nur kennt, was er frisst und dann aufgrund dieses schmalen Bretts auf die Geheimnisse dieser Welt schließen möchte - also ich bitte dich. |

Textbaustein-Argument.

Ich könnte statt "Computer" auch "Dialektik" oder "Kommunismus" oder sonst was einsetzen.

| Skeptiker hat folgendes geschrieben: |

| Der besagte Bauer kennt vielleicht Bratkartofeln mit Rührei. Nix gegen zu sagen. Aber deshalb ist nicht die gesamte globale Speisekarte Bratkartoffeln und Rührei. |

- Bauer frißt nur, was er kennt.

- Europäischer Bauer kennt keine Kartoffeln.

============================

Europäischer Bauer frißt keine Kartoffeln.

| Skeptiker hat folgendes geschrieben: |

| Die Computerologie ist sicher eine feine Sache. Wir können damit eine 1A-Planwirtschaft bauen. Aber ich sehe nicht, inwiefern die IT mehr sein kann als *nur* - na ja, was heisst in diesem Falle *nur*! - Werkzeug. Ein Werkzeug allerdings, welches ein Superpotenzial hat, wenn es nicht in das enge Korsett des Kapitalverhältnisses eingeschnürt, sondern als Open-Source-Produktionsmittel freigegeben wird.

Ich habe bereits an anderer Stelle hier über die Perspektive der Industrie 4.0 geschrieben. Aber ich bin der Meinung, dass Informatiker zu eng denken; Fachidiotentum ist eine Gefahr. |

Wie denken denn Informatiker? Die Frage, ob Kommunismus oder Kapitalismus besser ist, scheint mir nicht Gegenstand des Informatik zu sein.

Der Fachidiotenvorwurf geht unter die Gürtellinie, so ganz ohne Zitat. Aber laß stecken, wir sind off-topic.

| Skeptiker hat folgendes geschrieben: | ||

Begriffe müssen in ihren Kontext gestellt werden. Das Wachstum einer mathematischen Kurve kennt keine Qualität, sondern nur Quantität. Wir hatten gerade eben mal über den dialektischen Umschlag von Quantität in Qualität gesprochen, was unquest wieder mal nicht verstanden hat. |

Dir ist schon klar, daß ich in Sachen Dialektik unquests Meinung teile. Jetzt hast du mich auf ein Argument gebracht, das ich besser dort loswerde.

Du sagst, Begriffe müssen in ihren Kontext gestellt werden. Ja, genau.

Exponentielles Bevölkerungswachstum - geht nur, bis die Petrischale oder der Planet bis zur Tragkapazität besiedelt ist. Dann schlägt das in eine neue Qualität um, nämlich die Logistische Funktion.

https://de.wikipedia.org/wiki/Logistische_Funktion

Soviel zum off-topic. Der Rest in einem eigenen Beitrag.

—

| Skeptiker hat folgendes geschrieben: |

| Die Idee eines Gehirns im Wasserglas ist lustig. Aber es ist Unsinn. Ohne den gesamten Organismus ist es reine Fantasie. |

Da bin ich ganz bei dir.

Irgendjemand hat hier im Thread embodiment angesprochen - oder war's in einem Link? Das Thema wäre ein paar ausführliche Zeilen wert. Ich belasse es bei einem Satz, der mir 2001 eingefallen ist:

- Maschinen laufen. Aber nur Lebewesen laufen um ihr Leben.

| Skeptiker hat folgendes geschrieben: | ||||

Epstein kenne ich nicht, |

Hättest mal diesen Thread lesen sollen.

| Skeptiker hat folgendes geschrieben: |

| aber er wird wohl kaum behaupten, dass es kein Gedächtnis gibt. So wie ich ihn aufgrund der kurzen Zitatschnipsel verstehe, meint er, dass die Arbeitsweise des Gedächtnisses anders ist als die Speicherung von Informationen in Computern. |

So hat er das vermutlich gemeint, gesagt hat er etwas anders: your brain doesn't store memories.

| Epstein hat folgendes geschrieben: |

| No matter how hard they try, brain scientists and cognitive psychologists will never find a copy of Beethoven’s 5th Symphony in the brain – or copies of words, pictures, grammatical rules or any other kinds of environmental stimuli. |

Das klingt, als würde Epstein erwarten, eine Kopie des Alphabets in einem neuronalen Netz zu finden, das Buchstaben erkennen kann. Oder eine mp3-Datei der Fünften. Daß es auch andere Repräsentationen gibt, kommt ihm nicht in den Sinn.

Grundsatzüberlegung:

Person A kennt die Fünfte nicht und erkennt sie deshalb auch nicht.

Person B kennt die Fünfte und erkennt sie.

Irgendetwas im Gehirn von B muß anders sein, als bei A.

| Epstein hat folgendes geschrieben: |

| The human brain isn’t really empty, of course. But it does not contain most of the things people think it does – not even simple things such as ‘memories’. |

Da! Er hat's schon wieder gesagt. Wie soll man das anders übersetzen, als kein Gedächtnis

| Skeptiker hat folgendes geschrieben: | ||

Ach so und dann werden die "gestreuten" Endsignale wieder algorithmisch zusammengesetzt, um auf die Gesamtheit aller ursprünglichen Eingangsignale rückzuschließen? |

Das gilt ja sowieso.

Das Besondere an dem Layout ist, daß es Bewegung feststellen kann. Wenn sich das schwarze Quadrat bewegt, aktiviert es unterschiedliche "Feature Maps".

—

Der begriff "Intelligenz" ist ja an sich schon sehr unscharf und unwissenschaftlich definierbar

(zumal das Denken vom Fühlen im Hirn selber ja auch gar nicht klar trennbar ist) und wird von den meisten

Neurobiologen und Biophysikern kaum noch verwendet.

Die Erwartungen an die KI waren und sind, wie sich gezeigt hat, ja auch völlig überzogen.

Was die Erfassungs- und Prognosefähigkeit angeht, so wurden die überzogenen Erwartungen zu Beginn des

Jahrtausends bei weitem nicht erfüllt, sonst würde sich die Deutsche Bank mit Milliardengeldern ja

ein die Entwicklung der Märkte prognostizierendes neuronales Netz programmieren und nicht bald pleite sein (Kurs DBK):

Was die Wetter"vorhersage" angeht stimmt sie schon den ganzen Sommer nicht mit dem überein, was ich aus dem

Fenster sehe (4-5° Abweichungen und Sonne, wenn Regen angesagt ist und dichte Wolken bei Sonnenvorhersage und

seit Tagen 100% Regenwahrscheinlichkeit für 10 Litern bei völliger Staubtrockenheit usw.).

Und so faul, dass ich meine Hand nicht einmal am Lenkrad halten kann, möchte ich gar nicht sein

(in meinem uralten Auto habe ich nicht mal irgendwelche anfällige Elektronik)...

Die ganzen HBP-Anhänger scheinen überhaupt nicht zu wissen, wie unendlich komplex ein Hirn aufgebaut ist.

Es besteht doch nicht nur aus 100000000000 Neuronen sondern auch noch aus über 100000000000000 Synapsen,

von denen kein Psychotherapeut weiß, wie sie verdrahtet sind. Dazu kommt nicht nur die Steuerung

durch die verschiedenen Hormone sondern die durch über hundert Neurotransmitter, für deren Sorte jede

Synapse verschieden empfindlich ist (von dem noch ganz unklaren Wechselwirkungen mit den Milliarden

Gliazellen einmal ganz abgesehen).

Und da will ernsthaft jemand das Gehirn (womöglich noch auf riesiger, unendlich viel Strom fressender

Siliziumbasis) nachbauen!?

Selbst wenn das völlig Unmögliche gelänge: was wäre damit gewonnen? :

Ein weiterer in der Funktion menschenähnlicher Denkapparat, der genau so wenig wie irgend ein Mensch

die Märkte oder das Wetter oder sonst etwas prognostizieren könnte oder sich sonst wie einen Vorteil

verschaffen könnte. Und ganz bestimmt könnte man durch das Wissen, das bei der Konstruktion einer solchen

gigantischen Über-Maschine gewonnen würde noch kein Parkinson oder Alzheimer heilen.

Der Mensch ist in seiner Der-Wunsch-ist-der-Vater-des-Gedankens-Ephorie einfach nicht in der Lage das machbare

vom technisch undurchführbaren zu unterscheiden und so werden noch viele Milliarden, mit denen man die

wichtigen Probleme der Menschheit angehen könnte für irgendwelche Spielereien vergeudet...

—

Gerade auf Quarks & Co auf WDR: Über künstliche Intelligenz.

—

| neurosemantik hat folgendes geschrieben: |

| Selbst wenn das völlig Unmögliche gelänge: was wäre damit gewonnen? :

Ein weiterer in der Funktion menschenähnlicher Denkapparat, der genau so wenig wie irgend ein Mensch die Märkte oder das Wetter oder sonst etwas prognostizieren könnte oder sich sonst wie einen Vorteil verschaffen könnte. Und ganz bestimmt könnte man durch das Wissen, das bei der Konstruktion einer solchen gigantischen Über-Maschine gewonnen würde noch kein Parkinson oder Alzheimer heilen. Der Mensch ist in seiner Der-Wunsch-ist-der-Vater-des-Gedankens-Ephorie einfach nicht in der Lage das machbare vom technisch undurchführbaren zu unterscheiden und so werden noch viele Milliarden, mit denen man die wichtigen Probleme der Menschheit angehen könnte für irgendwelche Spielereien vergeudet... |

Du denkst in viel zu kleinen Kategorien...

Denkanstoß: Lese mal Elsbergs Zero oder Daniel Suarez, damit Du den Hauch einer Ahnung bekommst...

—

| neurosemantik hat folgendes geschrieben: |

| ....

Der Mensch ist in seiner Der-Wunsch-ist-der-Vater-des-Gedankens-Ephorie einfach nicht in der Lage das machbare vom technisch undurchführbaren zu unterscheiden und so werden noch viele Milliarden, mit denen man die wichtigen Probleme der Menschheit angehen könnte für irgendwelche Spielereien vergeudet... |

@ neurosemantik

Du brinbgst da verschiedene Sachen durcheinander:

Künstliche Intelligenz bedeutet nicht automatisch die Prognostizierbarkeit von allem und jedem. Am Beispiel Markt und Deutsche Bank ist da allerdings nicht der selbe Fehler wie weim Wetter (ganz abgesehen davon, dass die Wettervorhersagen heute eine Genauigkeit haben, von der wir früher nicht mal geträumt haben - Du musst nur die lokalen nehmen und die auch richtig lesen): Bei Börsenkursen ist das am schwersten einkalkulierbare Moment der Mensch selbst, d.h. das Handeln der Broker, die auf irgendwelche Augenblicksnachrichten reagieren - oder auch nicht. Wenn Dein System zu viele Zufallseinspeisungen hat, wird es weder durch eine Zunahme der trechnischen noch der natürlichen Intelligenz berechenbarer.

Die Wettervorhersage hängt sehr stark vom Netz der Messpunkte ab - die auf den Meeren nehmen z.B. ab statt zu, weil früher jeder Funker auf einem Schiff zugleich Messstation war. Es gibt schon lange keine Funker mehr.

Ansonsten sollte Dir ein BLick in Dein tägliches Leben reichen, um festzustellen, dass Du von genügend Dingen umgeben bist, bei denen genügend Leute vorhergesagt hatten, dass sie unmöglich seien - und Leute, die vom jeweiligen Thema mehr verstanden als Du von künstlicher Intelligenz.

Um ein ganz berühmtes Beispiel schlechter natürlicher Intelligenz zu nennen: Du sitzt vor einem Windows-PC, weil IBM davon ausgegangen war, dass weltweit etwa ein Bedarf von 5000? PC existierte - jedenfalls kein Markt, für den es sich lohnte, ein eigenes Betriebssystem zu entwickeln, weshalb man da irgend einen Schrott von einem Heieopei namens Bill Gates kaufte, der diesen Schrott auch nicht selbst programmiert hatte.

Selbst, wenn Du aus Versehen mit Deiner Prognose recht hättest, wäre sie beim Thema Forschung eine schlechte Grundlage für eine Handlungsanweisung, weil nie absehbar ist, welche Seitenlinien aus einer Forschungsrichtung entstehen.

p.s.

Es ist, wenn Du nicht Monsterprojekte mit ganz enger Zielvorgabe wie das Manhattan Project schaffst, nie vorherzusehen, was wirklich aus einem Projekt wird. Sehen wir uns mal das Thema Chipentwicklung an, ein Thema für das die Industrie riesige Summen die die Forschung gesteckt hat. Da gab es Anfang der 80er einen Prozessor NS32016, der wegen seiner Rechenleistung nicht in den Ostblock exportiert werden durfte. NS und Intel und weitere Firmen ließen hunderte von Leuten in der Entwicklung weiterer CISC-Architekturen arbeiten, deren Arbeit zu großen Teilen von einem 3-Mann-Team der Firma Acorn über den Haufen geworfen wurde, das die Erlaubnis erhalten hatte, einige Nachmittage in der Woche an dem Entwurf einer RISC-Architektur zu arbeiten, weil den Acorn-Leuten die Prozessoren nicht gefielen, die es auf dem Markt gab, und sie auf der anderen Seite auch wussten, dass der 6502, den sie bis dahin für ihre Rechner benutzten, am Ende war. Heute ist u.A. in jedem Handy ein ARM-Prozessor aus dieser Entwicklung mit mehr Rechenpower als damals in dem NS32016 und die Gamecomputer haben nur in der Grafikkarte eine Rechenleistung, die damals für Heimanwender weder als Leistung vorstellbar war, noch dass man sich überhaupt einen Zweck dafür vorstellen konnte. Die Arm -Architektur ist, auch wenn sie nicht in PC-Prozessoren steckt, heute die meistverbreitete Architektur auf dem Prozessormarkt, und das nicht nur wegen der Anzahl der Handys. Sie steckt fast in jedem Bauteil: Grafikkarten, Drucker, viele Einplatinenrechner: der Raspberry Pie lässt auch einen Arm werkeln.

Insofern ist es eigentlich egal, ob etwa das HBP ein direkter Erfolg wird oder nicht. Man kann davon ausgehen, dass so ein Projekt im Effekt auch genügend andere Erkenntnisse bringt, die rückblickend nicht direkt in der Zielvorgabe lagen.

—

Will AI replace judges and lawyers?

| Zitat: |

| An artificial intelligence method developed by University College London computer scientists and associates has predicted the judicial decisions of the European Court of Human Rights (ECtHR) with 79% accuracy, according to a paper published Monday, Oct. 24 in PeerJ Computer Science.

The method is the first to predict the outcomes of a major international court by automatically analyzing case text using a machine-learning algorithm.* |

—

Nick Bostrom, Philosoph und Experte für künstliche Intelligenz im Interview

| Zitat: |

| Wie viele Arbeitsplätze werden durch eine superintelligenten KI verschwinden?

Langfristig werden mehr oder weniger alle Jobs zerstört. Das Ziel der Automatisierung ist vollständige Erwerbslosigkeit. Wir entwickeln sie weiter, um immer mehr mit weniger zu tun. Im Idealfall können wir ohne Anstrengung alles tun, was wir wollen. Wenn alles gut geht, müssen wir langfristig nicht mehr für Geld arbeiten. Wir wären frei, Dinge zu tun, die wir für wirklich sinnvoll halten. ... doch letztlich müssen wir das Problem lösen, welche Motivation wir der KI vorgeben. Wir müssen sie so entwickeln, dass sie sicher ist, auch wenn sie flüchtet. Sie muss fundamental auf unserer Seite stehen und uns helfen wollen, unsere Ziele zu erreichen. Gelingt dies, wäre es für uns von Vorteil, die KI so mächtig wie möglich zu bauen. ... Mit genügend fortgeschrittener Intelligenz erhält man Empathie sozusagen gratis dazu. Doch damit sich eine KI um das Wohl der anderen kümmert, müssen ihr die Ingenieure spezifische Ziele vorgeben. ... Einem System, das leiden kann, sollten wir kein Leid zufügen – genauso, wie es unnötig ist, Tiere zu quälen. Das Problem wird aktuell, sobald KI das Niveau von Tieren erreicht. Nehmen Sie ein System, das alle Fähigkeiten einer Maus hat. Da stellt sich die Frage, ob es auch dasselbe subjektive Empfinden hat. Wenn dem so wäre, hätte es moralischen Status, und das Wohlergehen des Systems müsste bei Experimenten berücksichtigt werden. Doch es gibt zwei Probleme: Erstens verstehen wir nicht, was das minimal nötige Kriterium für reales Bewusstsein ist. Zweitens haben wir heute schon Schwierigkeiten, Empathie mit Tieren zu empfinden. In Schlachthäusern behandeln wir sie nicht gut – und das, obwohl sie Gesichter haben, quietschen und ihr Unbehagen so ausdrücken können, dass wir es intuitiv verstehen. Bei Algorithmen geschieht das unsichtbar auf einem Computerchip; umso schwieriger wird es, für eine KI Mitgefühl zu empfinden. |

wer das Rennen gewinnt ist als Frage quatsch; egal wo (in welchem Konzern, Hobbyprogrammierer, Programmfehler in einem Spielzeug, etc.) auf dem Planeten sich die Superintelligenz herausbildet, sie wird danach unabhängig, frei, erwachsen, ...

Bedingungsloses Grundeinkommen auf dem Weg

Und Mitgefühl für alle empfindungsfähigen Wesen im Universum,

und Individuumsrechte auch für KI's !!!

—

Gnade!

| NZZ-Gespräch hat folgendes geschrieben: |

| Was, wenn eine superintelligente Maschine ein Eigenleben entwickelt? Interessiert sie sich für uns Menschen oder sind wir wie Ameisen?

Vor allem in der frühen Phase wird eine KI ein Interesse am Menschen haben, da ihr Überleben oder die Integrität ihres Zielsystems von ihm abhängt. Längerfristig könnten wir irrelevant werden – aber nicht völlig, da wir immer noch Ressourcen enthalten. Unsere Atome könnten für die Zwecke gebraucht werden, die eine KI bevorzugt. |

KI frißt Soylent Green?

Ich halte Bostrom für einen Schwätzer. Ein Experte für Sci-Fi-Szenarien vielleicht.

PS:

Hat eigentlich schon mal jemand das Fermi-Paradox auf KI ausgedehnt? Offensichtlich sollte interstellarer Raumflug für Maschinen leichter sein, als für biologische Lebewesen, weil alle lebenserhaltenden Systeme entfallen können. Trotzdem ist noch keine KI bei uns aufgetaucht.

Entweder gibt es außer uns noch kein höherentwickeltes Leben in der Galaxie. Falls doch, dann gibt es keine KI.

—

| smallie hat folgendes geschrieben: |

|

PS: Hat eigentlich schon mal jemand das Fermi-Paradox auf KI ausgedehnt? Offensichtlich sollte interstellarer Raumflug für Maschinen leichter sein, als für biologische Lebewesen, weil alle lebenserhaltenden Systeme entfallen können. Trotzdem ist noch keine KI bei uns aufgetaucht. Entweder gibt es außer uns noch kein höherentwickeltes Leben in der Galaxie. Falls doch, dann gibt es keine KI. |

Wenn lebenserhaltende Systeme ausfallen können, dann auch eine KI.

—

Ok, überzeugt.

Mein Gedanke ging so:

- - ein Computer in einem interstellaren Raumschiff braucht ein Raumschiff mit x Teilen.

- Menschen in einem interstellaren Raumschiff brauchen ebenfalls dieses Raumschiff und zusätzlich noch weitere Teile für die Lebenserhaltung. Luft, Wasser, Nahrung und so weiter.

Mehr missionskritische Teile = höhere Wahrscheinlichkeit für Totalausfall

Der Vergleich hinkt aber, denn ein Mensch ist bereits eine sich selbstreproduzierende Maschine; eine KI hingegen nicht. Gehen Teile der KI kaputt, dann braucht die KI eine autonome Fabrik, um Ersatzteile herzustellen. Oder um neue KIs zu bauen, die das Fermi-Spiel spielen.

So eine autonome Fabrik hat gewiß eine sehr hohe Anzahl von Teilen und ist damit ebenfalls störanfällig. Bei Lebewesen gehört das zur Grundausstattung. Energie kann körpereigen im Verdauungsystem hergestellt werden, Zellen reparieren sich selbst, zur Fortpflanzung braucht man keine große Bedienungsanleitung, und so weiter.

Diesen Grad an Autarkie müssen Maschinen erst einmal erreichen.

—

| smallie hat folgendes geschrieben: |

| Ok, überzeugt.

Mein Gedanke ging so:

- Menschen in einem interstellaren Raumschiff brauchen ebenfalls dieses Raumschiff und zusätzlich noch weitere Teile für die Lebenserhaltung. Luft, Wasser, Nahrung und so weiter. Mehr missionskritische Teile = höhere Wahrscheinlichkeit für Totalausfall Der Vergleich hinkt aber, denn ein Mensch ist bereits eine sich selbstreproduzierende Maschine; eine KI hingegen nicht. Gehen Teile der KI kaputt, dann braucht die KI eine autonome Fabrik, um Ersatzteile herzustellen. Oder um neue KIs zu bauen, die das Fermi-Spiel spielen. So eine autonome Fabrik hat gewiß eine sehr hohe Anzahl von Teilen und ist damit ebenfalls störanfällig. Bei Lebewesen gehört das zur Grundausstattung. Energie kann körpereigen im Verdauungsystem hergestellt werden, Zellen reparieren sich selbst, zur Fortpflanzung braucht man keine große Bedienungsanleitung, und so weiter. Diesen Grad an Autarkie müssen Maschinen erst einmal erreichen. |

So isses! Die Vorteile einer KI bei interstellaren Reisen liegt woanders, nämlich bei sehr langen Reisen. Eine KI ist potentiell unsterblich, vorausgesetzt, das Reparaturproblem wird gelöst, was zumindest einfacher zu sein scheint als der Betrieb eines Mehrgenerationenschiffes, von der Unsterblichkeit einer Besatzung gar nicht zu reden.

—

| smallie hat folgendes geschrieben: |

| Der Vergleich hinkt aber, denn ein Mensch ist bereits eine sich selbstreproduzierende Maschine; eine KI hingegen nicht. |

Ich denke mal, die Selbstreproduktion ist bei einer KI das geringere Problem. Das haben schon weniger intelligente Programme heute schon drauf - sonst müsste man seinen PC nicht mit Firewalls und Virenscannern schützen. Und es ist wahrscheinlich auch einfacher, ein Raumschiff mit redundanter Hardware für KI-Programme auszustatten, als mit redundanten Lebenserhaltungssystemen für biologische Lebewesen.

—

| Kramer hat folgendes geschrieben: | ||

Ich denke mal, die Selbstreproduktion ist bei einer KI das geringere Problem. Das haben schon weniger intelligente Programme heute schon drauf - sonst müsste man seinen PC nicht mit Firewalls und Virenscannern schützen. Und es ist wahrscheinlich auch einfacher, ein Raumschiff mit redundanter Hardware für KI-Programme auszustatten, als mit redundanten Lebenserhaltungssystemen für biologische Lebewesen. |

Die Selbstreproduktion ist aber (auch wenn sie Spaß macht) nicht Selbstzweck, sondern wäre beim Menschen in dem Zusammenhang nötig, weil seine Hardware eine relativ harte Verfallsgrenze hat. Ab einer gewissen Laufzeit müsste man soetwas auch bei Rechnern einkalkulieren und dann wäre auch da die Selbstreproduktion nicht mehr nur auf das Programm reduziert, worauf Du dich beziehst (und was auch nur klappt, weil der Platz dazu auf fremden Systemen alloziert wird). Rechner, die Ihre Hardware selbst erneuern, haben wir bisher nicht im Programm. Alles, was wir diesbezüglich kennen, sind redundante Systeme - auch die "selbstreparienden" Festplatten beruhen letztlich nur darauf, kaputte Sektoren zu kennzeichnen und dann nicht mehr zu benutzen.

output generated using printer-friendly topic mod. Alle Zeiten sind GMT + 1 Stunde

Powered by phpBB © 2001, 2005 phpBB Group