—

angeregt durch @fwo's OT:

| fwo hat folgendes geschrieben: | ||

|

Btw. Zukunftsszenarien: Bisher habe ich bezüglich weiterer Automatisierungsfolgen für den Arbeitsmarkt nur meine eigene Meinung vertreten. Inzwischen bin ich aus Versehen (ich suchte eigentlich was anderes) in einem relativ neuen Spektrum (1/16 : S.51, Digitale Demokratie statt Datendiktatur von Dirk Helbing, Bruno S.Frey, Gerd Gegerenzer, Ernst Hafen, Michael Hagner, Yvonne Hofstetter, Jeroen van den Hoven, Roberto V. Zicarl und Andrej Zwitter) auf folgende Prognose gestoßen:

Die Autoren sind allesamt nicht als Spinner bekannt, und diese Aussage ist mit Sicherheit keine Gefälligkeit für die Industrie oder irgendeine Regierung (auch sowas findet man im Spektrum). Und selbst, wenn sie sich in der Zeit um den Faktor 2 vertun, dann wären sie ca. bei meiner vorsichtigeren Schätzung, ist diese Aussage in Schlag ins Gesicht aller Wirtschaftsfritzen, die Deutschland für diese Verjüngung gratulieren. (Man kann sich höchstens fragen, von wem die dafür bezahlt werden.) |

http://www.spektrum.de/news/maschinenlernen-deep-learning-macht-kuenstliche-intelligenz-praxistauglich-spektrum-de/1220451

| Zitat: |

| "In der Geschichte der KI reiht sich Misserfolg an Misserfolg, aber dazwischen gab es immer wieder entscheidende Fortschritte", meint einer der Pioniere des Deep Learning, Yann LeCun, derzeit Direktor des Center for Data Science der New York University, "mit einem solchen Sprung nach vorn können wir es hier zu tun haben."

"In den nächsten Jahren werden wir eine Art Rausch erleben", pflichtet ihm Jitendra Malik bei. "Eine Menge Leute werden auf den Deep-Learning-Zug aufspringen", so der Experte für computergestützte Bilderkennung an der University of California in Berkley. Doch auf lange Sicht sei Deep Learning womöglich nicht der Weisheit letzter Schluss. Andere Ansätze hätten ebenfalls Potenzial. |

Lernfähige Heuristiken zur Analyse/Mustererkennung von Bigdata machen in der Tat rasche Fortschritte, nur habe ich persönlich ein "Problem" damit, das als besonders intelligenten Einsatz von Computing zu werten.

Zweckoptimierte kommerzielle Massenmanipulationsversuche vs. intelligenter Einsatz der IT als Hilfsmittel gesellschaftlicher (Kommunikations-)Prozesse ?!

edit PS: noch ein weiterer Artikel zu dem Thema ...

—

| Er_Win hat folgendes geschrieben: |

| angeregt durch @fwo's OT:....

edit PS: noch ein weiterer Artikel zu dem Thema ... |

Ups.

Das ist der, aus dem ich zitiert hatte. Ich hatte nicht gesehen, dass der öffentlich ist. Danke für den Link.

—

| Er_Win hat folgendes geschrieben: | ||||||

angeregt durch @fwo's OT:

http://www.spektrum.de/news/maschinenlernen-deep-learning-macht-kuenstliche-intelligenz-praxistauglich-spektrum-de/1220451

Lernfähige Heuristiken zur Analyse/Mustererkennung von Bigdata machen in der Tat rasche Fortschritte, nur habe ich persönlich ein "Problem" damit, das als besonders intelligenten Einsatz von Computing zu werten. Zweckoptimierte kommerzielle Massenmanipulationsversuche vs. intelligenter Einsatz der IT als Hilfsmittel gesellschaftlicher (Kommunikations-)Prozesse ?! edit PS: noch ein weiterer Artikel zu dem Thema ... |

Ich finde, dass die Entwicklung der IT der Menschheit fantastische Möglichkeiten bietet. Es ist ja auch immer mehr die Rede von *Big Data*, *Industrie 4.0* oder *Arbeit 4.0* mit totaler Flexibilität und ach haste nich gesehen. Und *natürlich* führe dies zu *Problemen* usw. usf.

Es ist in der Tat keine Frage, ob man solche Technologien einsetzt, sondern für wen, durch wen und unter wessen Kontrolle:

a) - demokratisch,

b) - technokratisch oder

c) - kommerziell

Und da muss die Antwort doch eindeutig ausfallen.

Wenn der Fortschritt der Menschheit und ihrer Kultur primär im Sinne von b und c gesehen wird, dann wird es eine neue Stufe der Barbarei werden und nichts anderes - eine Barbarei 4.0, wenn man so will.

Ohne totale Demokratie auf dem gesamten Planeten und unter Einreissen aller nationalen Grenzen wird es keinen kulturellen Fortschritt mehr geben.

Deswegen ist die ganze Technikfixierung eine gefährliche Sache. Zur Zeit ist die Technik auch wirklich das einzige, was sich an dieser Gesellschaft überhaupt noch weiter entwickelt. Na ja gut, wenn man von den einschlägigen *Kulturkämpfen* mal absieht, welche den menschlichen Fortschritt vorwiegend in einem anderen Denken verorten ...-

—

fast OT

| Skeptiker hat folgendes geschrieben: |

|

Ohne totale Demokratie auf dem gesamten Planeten und unter Einreissen aller nationalen Grenzen wird es keinen kulturellen Fortschritt mehr geben. Deswegen ist die ganze Technikfixierung eine gefährliche Sache. Zur Zeit ist die Technik auch wirklich das einzige, was sich an dieser Gesellschaft überhaupt noch weiter entwickelt. Na ja gut, wenn man von den einschlägigen *Kulturkämpfen* mal absieht, welche den menschlichen Fortschritt vorwiegend in einem anderen Denken verorten ...- |

hervorhebung von mir

ich bin gestern beim zappen auf 3Sat hängen geblieben

Komplexe Welt - Ratlose Menschen

Alexander Kluge zu Gast bei Richard David Precht

nach kurzer Zeit musste ich dringen weiterschalten

Den Alexander Kluge mag ich ja, aber was der Precht da so von sich gegeben hat, nääe

Bei Precht wurden deine einschlägigen, nationalen *Kulturkämpfe* von ihm fast verherrlicht (zumindest in den Minuten die ich gesehen hab)

Abgekapselte Traditionen zur eigenen Identitätsfindung um jeden Preis? (igitt)

| Er_Win hat folgendes geschrieben: |

|

Lernfähige Heuristiken zur Analyse/Mustererkennung von Bigdata machen in der Tat rasche Fortschritte, nur habe ich persönlich ein "Problem" damit, das als besonders intelligenten Einsatz von Computing zu werten. Zweckoptimierte kommerzielle Massenmanipulationsversuche vs. intelligenter Einsatz der IT als Hilfsmittel gesellschaftlicher (Kommunikations-)Prozesse ?! |

Im Titel des Threads, genauso wie im obigen Zitat, betrachtest/hinterfragst du eher die intelligente Nutzung der neuen Möglichkeiten durch z.B. Deep Learning?!

Oder fragst du ob Deep Learning eine Art Intelligenz/Struktur aufweist, die der menschlichen Intelligenz ähnelt?

(wobei ich nur Fragen kann - von der Materie hab ich keine Ahnung)

ein paar laienhafte Einschübe

zu Zweckoptimierte kommerzielle Massenmanipulationsversuche

--> Cenk RAGES Against The Lies Of The Establishment Media

(kann man das auch auf gesellschaftliche/wissenschaftliche Meinungsverbreitung beziehen?)

und ich bin geflaaaasht von TYT

zu Deep Learning

--> Kurzweil Interviews Minsky: Is Singularity Near?

da gehts wenn ich mich recht erinnere auch um deep learning und wie man sich menschliche Intelligenz vorstellen sollte?! und wie sie vielleicht nachzubilden sei...

und alle den Termin im März freihalten:

Fällt "Go", nach Schach und Poker, als letzte Bastion menschlicher Spieleintelligenz an die KI ? !!!!

deepmind

| Zitat: |

| This paper published in Nature on 28th January 2016, describes a new approach to computer Go that combines Monte-Carlo tree search with deep neural networks that have been trained by supervised learning, from human expert games, and by reinforcement learning from games of self-play. |

DeepMind-Wikipedia

| Zitat: |

| Das offizielle Unternehmensziel von Google DeepMind ist, Intelligenz zu verstehen ("Solve Intelligence"). Im Gegensatz zu anderen künstlichen Intelligenzen wie z.B. DeepBlue von IBM hat Google DeepMind kein vordefiniertes Ziel und ist somit flexibler in der Anwendung für verschiedene Probleme. Google DeepMind unterscheidet sich ebenfalls in der grundsätzlichen Strukturierung der künstlichen Intelligenz. Statt ausschließlich auf ein neuronales Netz zu setzen, erweiterte man die KI mit einem Kurzzeitspeicher, um somit die Fähigkeit eines künstlichen Gedächtnisses zu simulieren. Die Entwickler von Google DeepMind bezeichnen die künstliche Intelligenz deshalb auch als "neuronale Turing Maschine" und nicht als neuronales Netz. |

hübsche Liste

List of artificial intelligence projects

—

Die Eingangsfrage scheint mir mehrdeutig zu sein.

a) Taugt deep learning, um so etwas wie Intelligenz zu erzeugen?

b) Wird deep learning intelligent eingesetzt?

Das hier scheint eher für b) zu sprechen:

| Er_Win hat folgendes geschrieben: |

| Lernfähige Heuristiken zur Analyse/Mustererkennung von Bigdata machen in der Tat rasche Fortschritte, nur habe ich persönlich ein "Problem" damit, das als besonders intelligenten Einsatz von Computing zu werten.

Zweckoptimierte kommerzielle Massenmanipulationsversuche vs. intelligenter Einsatz der IT als Hilfsmittel gesellschaftlicher (Kommunikations-)Prozesse ?! |

Was deep learning mit "zweckoptimierten kommerziellen Massenmanipulationsversuchen" zu tun hat, ist mir nicht klar. (Korrektur: unten ist mir noch was dazu eingefallen.)

Ziemlich sicher bin ich mir, daß neuronale Netze - und deep learning ist im Prinzip nur ein aufgebrezter Name für Neuronale Netze mit versteckten Layern - der einzige Weg sind, um eine echte KI zu bauen. Alle anderen Methoden - ich nenne sie mal die formalen, aussagenlogischen - funktionieren nur bei eng umschränkten Einsatzgebieten.

Wobei: vielleicht bin ich da nicht auf dem aktuellen Stand. IBMs Watson ist, glaube ich, kein neuronales Netz. Da müßte ich erst nachlesen, was die genau machen.

Übrigens hat IBM vor einigen Monaten fleißig Werbung für Watson geschalten (bei stack exchange gesehen). Webseiten können Watson zum Beispiel nutzen, um die Stimmungen von Kunden anhand ihrer Texteingaben zu erkennen, etwa im Beschwerdemanagement. (oder ging es um Anrufe und Spracherkennung?)

Da fällt mir noch was ein. Amerikanische Krankenkassen nutzen Spracherkennung, um herauszufinden, ob ihre Kunden wirklich krank waren, oder nur simulierten... Das würde dann in die Richtung gehen, die du ansprichst. Ob das legitim ist, lasse ich an dieser Stelle offen.

PS:

so einen Wischi-Waschi-Beitrag habe ich schon lange nicht mehr geschrieben.

—

| smallie hat folgendes geschrieben: |

| Die Eingangsfrage scheint mir mehrdeutig zu sein.

a) Taugt deep learning, um so etwas wie Intelligenz zu erzeugen? b) Wird deep learning intelligent eingesetzt? |

ist mir bewußt und war durchaus so gemeint...

a) verneine ich - zumindest nach meinem Verständnis von Intelligenz.

—

Was leisten künstliche neuronale Netze?

- Weniger als 100 Neuronen reichen, um Buchstaben einer 5 x 7 Matrix zu erkennen.

Weniger als 100 000 Neuronen reichen, um klassische Atari-2600-Computerspiele zu meistern.

Was könnten Netze mit 80 000 000 000 Neuronen wohl leisten? Ungefähr so viele Gehirnzellen hat der Mensch.

Ich zweifle keine Sekunde daran, daß neuronale Netze ein Weg wären, um echte KI zu bauen. Allerdings bin ich mir nicht sicher, ob es technisch möglich ist, einen Computer zu bauen, der 80 000 000 000 Neuronen in Echtzeit berechnen kann. Ich denke nicht, daß sich Moore's Law beliebig weit fortsetzt. Zumindest nicht mit heutiger Technik.

(Dieser Beitrag wurde mit 40 Watt Grundumsatz des menschlichen Körpers erstellt.

—

| smallie hat folgendes geschrieben: |

Was leisten künstliche neuronale Netze?

Weniger als 100 000 Neuronen reichen, um klassische Atari-2600-Computerspiele zu meistern. Was könnten Netze mit 80 000 000 000 Neuronen wohl leisten? Ungefähr so viele Gehirnzellen hat der Mensch. Ich zweifle keine Sekunde daran, daß neuronale Netze ein Weg wären, um echte KI zu bauen. Allerdings bin ich mir nicht sicher, ob es technisch möglich ist, einen Computer zu bauen, der 80 000 000 000 Neuronen in Echtzeit berechnen kann. Ich denke nicht, daß sich Moore's Law beliebig weit fortsetzt. Zumindest nicht mit heutiger Technik. (Dieser Beitrag wurde mit 40 Watt Grundumsatz des menschlichen Körpers erstellt. |

Es laufen gerade zwei Versuche einen Chip zu bauen, der die Neuronen nicht mehr simulieren muss, sondern der praktisch aus Halbleiter Neuronen besteht. Der Ansatz sieht mir vielversprechender aus.

Den einen habe ich wieder gefunden:

https://www.technologyreview.com/s/529691/ibm-chip-processes-data-similar-to-the-way-your-brain-does/

Das Problem warum neuronale Netzwerke noch nicht flächendeckend eingesetzt werden ist aber doch immer noch nicht gelöst oder? Wenn ich einem hinreichend komplizierten Netzt etwas beibringen, habe ich keine Garantie, das es das auch 100% immer und in jedem Fall so ausführt.

Es ist schwer genug bei berechenbarer Software die Fehler zu finden und auszumerzen, bei neuronalen Netzen steht man da blind bei Nacht im Nebel.

—

hier ein tolles Interview mit Jürgen Schmidhuber über unser aller Zukunft

http://www.infoq.com/articles/interview-schmidhuber-deep-learning

| göttertod hat folgendes geschrieben: |

|

Jürgen Schmidhuber |

und ich hab mich seit die Meldung raus kam gefragt, warum Google Boston Dynamics verkaufen will ????

Der Robotermarkt ist schließlich die Zukunft, und Google hat doch schon so viel perfekt harmonierendes KnowHow!

Ich habe gelesen Google hätte bedenken wegen eines schlechten Image, weil Roboter Arbeitsplätze wegnehmen.

Keine Angst haben - das ist eine TOLLE ENTWICKLUNG --> Bedingungsloses Grundeinkommen

Dann aber vor ein paar Tagen diese Erklärung

http://globalguerrillas.typepad.com/globalguerrillas/2016/03/why-did-google-dump-boston-dynamics.html

alphaGo rules!!!!

und hier ein abgefahren verständlich hübsch gemachter Artikel zur technologischen Singularität auf Elon Musks (z.B. Tesla) Lieblingsblog

http://waitbutwhy.com/2015/01/artificial-intelligence-revolution-1.html

—

| göttertod hat folgendes geschrieben: |

| hier ein tolles Interview mit Jürgen Schmidhuber über unser aller Zukunft http://www.infoq.com/articles/interview-schmidhuber-deep-learning |

Wobei das im Gegensatz zum später verlinkten Blog eine recht realistische Sicht bietet:

| Zitat: |

| Schmidhuber: It is a new branding of an old hat. It is mostly about deep neural networks with many subsequent processing stages, not just a few. With today’s faster computers, such nets have revolutionized Pattern Recognition and Machine Learning. The term "Deep Learning" itself was first introduced to Machine Learning by Dechter in 1986, and to Artificial Neural Networks (NNs) by Aizenberg et al in 2000. |

Da ich vor Zeiten mal auch selber mit einem Kollegen im Zuge des Studium an künstlich "intelligenten" Programmen (Schach) gearbeitet habe, die mich selbst dann geschlagen haben, frage ich mich heute hauptsächlich woher der populärwissenschaftliche Hype um künstliche "Intelligenz" kommt bzw. wie und warum diese *imho eher unsinnige Begriffsverbreitung in der IT Platz gegriffen hat.

Bei diversen Maschinen, welche die menschliche Muskelkraft auch um ein vielfaches übertreffen redet niemand von "künstlichen Muskeln" und bei einem ähnlichen begrifflichen "Relikt" - den PS von Autos - assoziieren im Gegenzug heute die wenigsten noch Pferde.

—

| Er_Win hat folgendes geschrieben: |

| ....

Da ich vor Zeiten mal auch selber mit einem Kollegen im Zuge des Studium an künstlich "intelligenten" Programmen (Schach) gearbeitet habe, die mich selbst dann geschlagen haben, frage ich mich heute hauptsächlich woher der populärwissenschaftliche Hype um künstliche "Intelligenz" kommt bzw. wie und warum diese *imho eher unsinnige Begriffsverbreitung in der IT Platz gegriffen hat..... |

Ich nehme an, worauf es den Leuten mit diesem Begriff ankommt, ist die Tatsache, dass Entwickler nur noch bedingt vorhersagen kann, was sein System macht, weil er zum Zeitpunkt der Entwicklung die Daten noch nicht kennt, die sein System in seinem Verhalten ändern werden.

Das ist schon ein gewisser Gegensatz dazu, dass es normalerweise (zu Recht) heißt, dass der Computer nur genau das tut, was der Programmierer ihm aufgetragen hat.

Intelligenz ist hier nichts anderes als ein Ausdruck für ein lernfähiges System. Kann man doch einfach so hinnehmen. (Ich gebe allerdings zu, dass ich auch gelacht habe, als ich ein einem Zeugnis mal lesen durfte, dass ich ein System entworfen hätte, dass in den Bereich KI gehört.)

Ansonsten ist KI natürlich auch einfach ein Werbebegriff wie umweltfreundlich oder sexy.

—

| fwo hat folgendes geschrieben: |

|

Intelligenz ist hier nichts anderes als ein Ausdruck für ein lernfähiges System. Kann man doch einfach so hinnehmen. |

ich nehme es durchaus hin

Ich wollte nur auf das, dem Begriff innewohnende und recht wirksame, assoziative Desinformationspotential hinweisen. Ich persönlich finde den Begriff "machine learning" einfach treffender, wenn auch weniger "sexy" ...

—

| Er_Win hat folgendes geschrieben: |

| Da ich vor Zeiten mal auch selber mit einem Kollegen im Zuge des Studium an künstlich "intelligenten" Programmen (Schach) gearbeitet habe, die mich selbst dann geschlagen haben, frage ich mich heute hauptsächlich woher der populärwissenschaftliche Hype um künstliche "Intelligenz" kommt bzw. wie und warum diese *imho eher unsinnige Begriffsverbreitung in der IT Platz gegriffen hat. |

*imho. So, so.

Wie und warum?

Du sitzt einem "falschen Freund" auf. Englisch Intelligence ist etwas anderes als deutsch Intelligenz.

Wer würde schon CIA mit Intelligenzhauptamt übersetzen?

KI begann mit Dingen wie Dijkstras Algorithmus oder A*-Algorithmus zur Findung eines optimalen Pfades. So finden Spielfiguren in den allermeisten Computerspielen noch heute ihren Weg. Oder Minimax-Algorithmus. Reicht für Dame oder Schach.

Damals war das schon was Neues und Besonderes.

Dann gab es regel- und wissensbasierte Systeme. MYCIN aus den 1970er Jahren war ein Forschungsprojekt mit praktischen Ablegern.

| wikipedia hat folgendes geschrieben: |

| Mycin

MYCIN war nie im praktischen Einsatz. Das lag nicht an schlechten Ergebnissen. Wie erwähnt schnitt es bei Tests besser ab als die Mitglieder der medizinischen Fakultät in Stanford. Einige Kommentatoren erhoben ethische und rechtliche Einwände gegen den Einsatz von Computern in der Medizin - sollte ein Programm eine falsche Diagnose stellen oder eine falsche Therapie vorschlagen, wer wäre verantwortlich? Original: MYCIN was never actually used in practice. This wasn't because of any weakness in its performance. As mentioned, in tests it outperformed members of the Stanford medical school faculty. Some observers raised ethical and legal issues related to the use of computers in medicine — if a program gives the wrong diagnosis or recommends the wrong therapy, who should be held responsible? https://en.wikipedia.org/wiki/Mycin |

PROSPECTOR (1977) war im praktischen Einsatz.

Die "klassische" KI besteht aus formalen Methoden und Heuristiken. Also ein "top-down"-Ansatz.

Neuronale Netze sind hingegen "bottom-up". Das ist eigentlich etwas anderes. Die passende Schublade AL - Artificial Life - hat sich nie so recht durchgesetzt. Darunter fallen auch agentenbasierte Simulationen oder genetische Algorithmen.

| Er_Win hat folgendes geschrieben: |

| Ich wollte nur auf das, dem Begriff innewohnende und recht wirksame, assoziative Desinformationspotential hinweisen. |

Starke Worte. Was ist jetzt aus deinem *imho geworden?

Reicht obiges, um auf das deinem Beitrag innewohnende und recht wirksame, assoziative Desinformationspotential hinweisen?

| Zitat: |

| Ich persönlich finde den Begriff "machine learning" einfach treffender, wenn auch weniger "sexy" ... |

Was ist "sexy"? Erzähl mir mehr!

—

| smallie hat folgendes geschrieben: |

|

Was ist "sexy"? Erzähl mir mehr! |

Das ist sexy

---->

| smallie hat folgendes geschrieben: |

| Die passende Schublade AL - Artificial Life - hat sich nie so recht durchgesetzt. |

Wobei mich hier immer das Adjektiv "künstlich" stört.

Aber nur, weil im Studium die religiöse Fraktion der Studenten (und teilweise der Lehrenden), das Wort genutzt haben, um das letztliche, zukünftige Resultat - bewusstes Leben - zu denunzieren, oder besser diesem Leben die Echtheit/Gleichwertigkeit abzusprechen.

(Alles in unserem Universum ist natürlich, selbst das künstliche.)

Ich freue mich schon auf das Zeitalter der Individuumsrechte!

—

| smallie hat folgendes geschrieben: | ||

*imho. So, so. Wie und warum? |

weil die "normalen" Heuristiken und neuronalen Netze noch immer recht wenig mit der Struktur und dem intelligenten Ergebnis dessen zu tun haben, was sich zwischen deinen Ohren abspielt. Selbst das HBP verzeichnet diesbzgl. bis dato eher bescheidene Fortschritte.

| smallie hat folgendes geschrieben: |

| Du sitzt einem "falschen Freund" auf. Englisch Intelligence ist etwas anderes als deutsch Intelligenz.

Wer würde schon CIA mit Intelligenzhauptamt übersetzen? [snip "wg. für mich überflüssigem Lehrveranstalungsversuch"...] |

wem sitze ich auf ? Ich schrieb, dass ich "machine learning" (bzw. maschinelles Lernen) treffender finde als KI. Was hat das jetzt mit deinem

-Hinweis bzgl. deutsch/englisch zu tun ?

-Hinweis bzgl. deutsch/englisch zu tun ?

AI bzw. KI werden synonym verwendet ...

| smallie hat folgendes geschrieben: |

| Was ist "sexy"? Erzähl mir mehr! |

ich finde es zumindest "unsexy", dass du die rein witzig gemeinte verbale Anspielung auf die von @fwo ins Spiel gebrachte Wertung des Begriff nicht erkannt hast

—

| göttertod hat folgendes geschrieben: | ||

Das ist sexy ----> |

Hmm. Das ist vieldeutig. *grübel*

Ich lese es mal als exponential enjoyment, dann passts.

| göttertod hat folgendes geschrieben: | ||

Wobei mich hier immer das Adjektiv "künstlich" stört. Aber nur, weil im Studium die religiöse Fraktion der Studenten (und teilweise der Lehrenden), das Wort genutzt haben, um das letztliche, zukünftige Resultat - bewusstes Leben - zu denunzieren, oder besser diesem Leben die Echtheit/Gleichwertigkeit abzusprechen. (Alles in unserem Universum ist natürlich, selbst das künstliche.) |

Ja, sicher.

Mach einen Vorschlag für einen besseren Ausdruck. Wenn er mir gefällt, übernehme ich ihn. Erwarte aber nicht, das der Rest der Welt das auch tut ...

| göttertod hat folgendes geschrieben: |

| Ich freue mich schon auf das Zeitalter der Individuumsrechte! |

Es bräuchte einen eigenen Thread, um alles aufzuschreiben, was mir dazu einfällt. Egalitarismus unter Jägern/Sammler habe ich schon oft erwähnt. Zum "Alltagsfaschismus" habe ich mich hie und da auch schon ausgelassen. (Nur noch nicht oft genug.

Aber das ist ein anderes Thema.

Soweit es diesen Thread betrifft, sage ich: warum sollte eine künstliche Intelligenz nicht auf den selben Käse hereinfallen wie eine natürliche? Oder anders gefragt: was hat KI mit Individuumsrechten zu tun?

—

| Er_Win hat folgendes geschrieben: | ||||

weil die "normalen" Heuristiken und neuronalen Netze noch immer recht wenig mit der Struktur und dem intelligenten Ergebnis dessen zu tun haben, was sich zwischen deinen Ohren abspielt. |

Das sagst du so. Kannst du das auch halbwegs begründen?

Bisher hast du es nicht für nötig befunden, dazu irgend etwas zu sagen:

| smallie hat folgendes geschrieben: |

| Was könnten Netze mit 80 000 000 000 Neuronen wohl leisten? Ungefähr so viele Gehirnzellen hat der Mensch. |

| Er_Win hat folgendes geschrieben: |

| Selbst das HBP verzeichnet diesbzgl. bis dato eher bescheidene Fortschritte. |

Ganz schlechte Referenz.

| smallie hat folgendes geschrieben: |

|

Das Blue-Brain-Projekt in der Schweiz wird scheitern. Ich möchte nicht unken, vermute aber, daß die dort nur einen epileptischen Anfall simuleren werden, um es salopp zu sagen. |

| Er_Win hat folgendes geschrieben: | ||

wem sitze ich auf ? Ich schrieb, dass ich "machine learning" (bzw. maschinelles Lernen) treffender finde als KI. Was hat das jetzt mit deinem  -Hinweis bzgl. deutsch/englisch zu tun ? -Hinweis bzgl. deutsch/englisch zu tun ?

AI bzw. KI werden synonym verwendet ...  |

Die Antwort stand in der geschnippten Lehrveranstaltung.

Du stellst dumme Fragen wegen der "unsinnigen Begriffsverbreitung", und wischst meine Antwort mit einem

beiseite.

beiseite.

Meine Tochter hat einen passenden Namen für Leute, die dein Verhalten zeigen: "Volltrotz".

—

Vom Algorithmus diskriminiert

Why Microsoft's 'Tay' AI bot went wrong

—

| Sermon hat folgendes geschrieben: |

| Vom Algorithmus diskriminiert |

Da findet etwas statt, das mir schon öfter aufgefallen ist, nämlich eine schleichende Begriffsverschiebung des Wortes "Algorithmus". Es wird von Algorithmus gesprochen, obwohl "Modell" oder "Regel" gemeint ist.

| Lange-Hausstein hat folgendes geschrieben: |

| Algorithmen entscheiden objektiv? Ein Märchen.

Dass Algorithmen objektiv entscheiden, ist dabei eine Mär. Weil sie von Menschen programmiert werden, spiegeln Algorithmen die Vorurteile ihres Programmierers. Code ist Werturteil. Algorithmen entscheiden zu lassen, ist zudem problematisch, weil sie durch Wiederholung menschlichen Verhaltens bereits vorhandene Diskriminierungen vertiefen. |

Ein Algorithmus ist ein Handlungsrezept, das bestimmte Probleme löst.

Schriftliches Addieren, Multiplizieren, usw. ist ein Algorithmus. Sortieren ist ein Algorithmus - und es gibt dutzende davon: Quicksort, Mergesort, Bubblesort, Radixsort, ... Breitensuche, Tiefensuche sind Algorithmen. Und sie sind alles andere als Vorurteilsbeladen oder Werturteile. Eine eigene Unterdisziplin der Computerwissenschaft beschäftigt sich mit der Beweisbarkeit von Algorithmen, darüber weiß ich aber nichts.

Nebenbei: Donald E. Knuth, der berühmteste aller Algorithmiker, zahlt allen, die einen Fehler in seinen Bücher finden, 2,56 $.

Das geht, weil Algorithmen objektiv sind. Lange-Hausstein hat da etwas mißverstanden. Diese Bedeutungsverschiebung ist ganz schlecht für die Debatte, weil sie den Unterschied zwischen objektiven Methoden und willkürlichen Diskriminierungen verwischt.

Was dabei herauskommt, sieht man hier:

| Lange-Hausstein hat folgendes geschrieben: |

| Gleichbehandlung ist eine Kategorie der Gerechtigkeit. Gerechtigkeit fordert aber nicht nur, Gleiches gleich zu behandeln. Für eine gerechte Entscheidung kann auch erforderlich sein, dass Ungleiches ungleich behandelt wird. Wenn sich ein potenzieller Kreditnehmer als Betrüger strafbar gemacht hat, wird die Entscheidung einer Bank, ihm einen Kredit nur gegen einen höheren Zins zu geben als anderen, kaum als ungerecht wahrgenommen werden. |

Seht ihr, was Christian Lange-Hausstein da gemacht hat? Er hat im Sinne seiner Definition einen Algorithmus angewandt.

Besser wäre es zu sagen, die Bank hat eine Regel aufgestellt. Damit wird ein Urheber genannt.

Zum Inhalt. Hören wir zelig:

| zelig hat folgendes geschrieben: |

| Stell dir einfach vor, der Mann raubt die Bank aus, bei der er ein Konto hat. Verliert der das Anrecht auf Zinsen für sein Guthaben? |

L-H: Wenn Betrüger, dann höherer Zins.

zelig: Wenn Bankräuber, dann trotzdem gleicher Zins.

Interessanter Widerspruch.

(Ich werde den Göttern eine Schale Reis opfern für diese glückliche Fügung des Schicksals.

| Lange-Hausstein hat folgendes geschrieben: |

| Anders sieht es aus, wenn der gegenüber anderen höhere Zins mit der Herkunft begründet wird. Der Grund für die Ungleichbehandlung ist entscheidend. Es gibt Gründe, die wir akzeptieren - Betrug - und Gründe, für die das nicht gilt - Herkunft. |

Aha. Ist jetzt der Algorithmus schuld an der Ungleichbehandlung? Es wäre besser, die Gründe anzugreifen, die einem nicht schmecken. Offensichtlich gehen die Meinungen auseinander, was gute und was schlechte Gründe sind.

| Sermon hat folgendes geschrieben: |

| Why Microsoft's 'Tay' AI bot went wrong |

Hehe. Gerade gestern sagte ich noch:

- warum sollte eine künstliche Intelligenz nicht auf den selben Käse hereinfallen wie eine natürliche?

Ein schönes Zitat findet sich im Link:

| Zitat: |

| "Any AI system learning from bad examples could end up socially inappropriate," Yampolskiy said, "like a human raised by wolves." |

Hat wohl Kiplings Dschungelbuch nicht gelesen.

Oder spricht Yampolskiy von homo homini lupus?

—

| smallie hat folgendes geschrieben: | ||

|

[...]

Es bräuchte einen eigenen Thread, um alles aufzuschreiben, was mir dazu einfällt. Egalitarismus unter Jägern/Sammler habe ich schon oft erwähnt. Zum "Alltagsfaschismus" habe ich mich hie und da auch schon ausgelassen. (Nur noch nicht oft genug. Aber das ist ein anderes Thema. Soweit es diesen Thread betrifft, sage ich: warum sollte eine künstliche Intelligenz nicht auf den selben Käse hereinfallen wie eine natürliche? Oder anders gefragt: was hat KI mit Individuumsrechten zu tun? |

Das "sexy" bezog sich auf dein "Artificial Life", oder besser auf das "Life". Ich habe mich einfach nur über die Bezeichnung "Leben" für eine KI gefreut - das ist alles.

Eine andere Bezeichnung brauche ich auch nicht unbedingt. Ich wollte nur meinen Unmut über z.B. Thomas Nagel, John Searle, & Co. zum Ausdruck bringen.

Auf deine Frage: "was hat KI mit Individuumsrechten zu tun?"

Der Threadtitel lautet:

"Deep-Learning ist das intelligent oder nicht ?"

Wenn ich "intelligent" auf die Weise lese, dass das zukünftige Resultuat eine Starke KI ist, dann stellt sich die Frage nach der Ethik, welche der Handlungen und dem Denken der Starken KI zugrunde liegt, und es stellt sich die Frage nach dem Einbetten solch eines Wesens in unsere Gesellschaft und in unser Werte- und Rechtssystem.

Ich meine der Sprung hin zur Starken KI dauert wohl noch einige Jahre, aber alleine die Zwischenschritte auf dem Weg dorthin müssen schon mit den gleichen Grundlagen/Mechanismen/Regeln arbeiten, die wir in unser Werte- und Rechtssystem einbetten.

Ein Objekt welches zum Subjekt wird.

https://de.wikipedia.org/wiki/Leben#K.C3.BCnstliches_Leben

Eigentlich ging es mir bei dem Link um die Definition von Leben, und in wie weit Maschinelles Lernen / Deep learning / Neuronale Netze, als notwendiger Teilbereich einer Starken KI, mit eine Voraussetzungen für eine Naturalistische Ethik sind.

https://de.wikipedia.org/wiki/Naturalismus_%28Philosophie%29#Drei_Probleme_der_Naturalisierung_des_Geistes

https://de.wikipedia.org/wiki/Roboterethik

Künstliche Intelligenz soll moralisches Handeln lernen – aus Geschichten

https://intelligence.org/2016/02/29/new-paper-defining-human-values-for-value-learners/

das paper: http://intelligence.org/files/DefiningValuesForValueLearners.pdf

| Sermon hat folgendes geschrieben: |

| Vom Algorithmus diskriminiert

Why Microsoft's 'Tay' AI bot went wrong |

Ich hab' mir auch gleich gedacht, es passt super hier rein.

Ethisches Verhalten braucht Wahrnehmung und Regeln.

Ein Chatbot, auch wenn er noch so weit entwickelt ist, ist nur eine Ansammlung von Wörtern nach Regeln. Und... ups jetzt stolper ich über mich selbst

Ein Chatbot, kann auch "echte"/humanistische/menschenrechtliche Ethik über Deeplearning entwickeln, wenn die Mehrheit keinen Quatsch erzählt. Doch diese erlernte Ethik ist noch nicht mit Bedeutung/Semantik gefüttert.

Dafür braucht es das Embodiment/die Verkörperung z.B. Boston Dynamics, (aber am Ende ist es eigentlich jedes Telefon, jeder Computer, Mikrowelle, Satelliten, etc., ...alles Elektronische)

Das Verständnis über ein eigenes Ich/Körper, wahrscheinlich die Verletzlichkeit, sind notwendig, um über die intersubjektive (zum Anfang noch intersubjektive/interobjektive) Kommunikation, die über z.B. DeepLearning erlernten Regeln mit Semantik zu füllen.

Das Buch kennt die Bedeutung seines Inhaltes nicht.

Das trotzdem noch ganz viel fehlt, um eine Starke KI zu entwickeln glaub ich sofort.

Aber wichtig im Hinblick auf die Entwicklung von Indiviuumsrechten (Rechte die allen kognitiven, zu Ich-Bewusstsein fähigen, und wohl auch anderen Wesen zugesprochen werden) sind hier schon die Zwischenschritte.

GoogleCars ist wohl das beste Beispiel, verknüpft mit dem Trolley-Problem

--> hin zum Utilitarismus als Naturalistische Ethik für alle,( weil kleinster gemeinsamer Nenner?)

| smallie hat folgendes geschrieben: | ||

|

ob im Programm jetzt eine Wertung implementiert ist, oder nicht, oder ob der Programmierer die Werte verinnerlicht hat, oder nur der Konsument des geäußerten, ist egal

Irgendwo in der Kommunikation stecken ethische Normen, und welche sollen das sein!

(1984?)

| göttertod hat folgendes geschrieben: |

|

1. objektive Wahrheit (der vertretenen Systemkomponenten/-manifestationen/-äußerungen; Transparenz) 2. Handlungsfreiheit (aller Individuen; dazu zählen vorrangig die Freiheitsrechte) 3. soziale Nützlichkeit/Hedonismus (als Schwerpunkt der vorallem politischen Entscheidungen; siehe z.B. EDIT: Deutscher Amtseid) (4. Diversität (entsteht aber automatisch, wenn die ersten drei Punkte eingehalten werden)) (zur Vertiefung von mir empfohlen John Stuart Mill / Freiheit / Wahrheit / (soziale) Nützlichkeit / Sozialstaat? |

neben GoogleCars z.B. IBM Watson im Gesundheitssystem

oder

http://www.aerztezeitung.de/politik_gesellschaft/medizinethik/article/907648/ethik-kuenstlicher-intelligenz-bleibt-menschen-uebrig.html

also ich finde Deep Learning schon ziemlich intelligent

schon echt cool

—

Noch zwei Anmerkungen zu meinem obigen Beitrag.

- In R&R sagte ich mehrmals, ich möchte nicht um Semantik streiten. Konsequenterweise darf ich mich dann jetzt auch nicht daran festbeißen, ob jemand Algorithmus oder Modell sagt.

- Speziell beim Beispiel mit der Bank und den Zinsen stellt sich noch die Frage nach unternehmerischer Freiheit. Aber das ist ein anderer Thread.

Zur Sache:

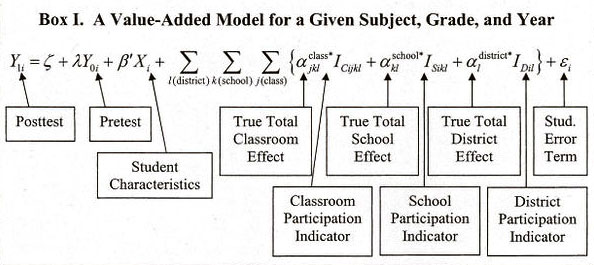

VALUE-ADDED-MODEL VAM

In manchen US-Bundestaaten werden Lehrer per Value-Added-Model VAM bewertet. VAM soll aus den Testergebnissen von Schülern anhand einer Formel die Qualität des Lehrers errechnen.

So sieht diese Formel aus:

| Zitat: |

| Evaluating New York Teachers, Perhaps the Numbers Do Lie

MICHAEL WINERIPMARCH 6, 2011

A statistical model the school system uses in calculating the effectiveness of teachers. http://www.nytimes.com/2011/03/07/education/07winerip.html |

Ein Mathelehrer hat sich die Daten näher angesehen. Wenn er sie nicht gefälscht hat, dann läuft da etwas gewaltig schief. Ohne Übersetzung, sondern in eigenen Worten beschrieben.

| Zitat: |

| Analyzing Released NYC Value-Added Data

Gary Rubinstein - 2012 (?) Rubinstein hat sich die VAM-Daten von 18 000 New Yorker Lehrern angesehen, die zwischen 2007 und 2010 erhoben wurden. Seine Annahmen waren: 1) Lehrer verbessern sich innerhalb eines Schuljahres kaum. 2) Lehrer können sich im Laufe ihrer Karriere verbessern, muß aber nicht sein. 3) Lehrer verbessern sich vom ersten auf's zweite Jahr am Meisten, weil sie dann ihre Materialien schon bereit haben, usw. Rubinstein hat die Zahlen nach verschiedenen Kriterien ausgewertet. Zunächst setzte er die Punktzahl eines Lehrer mit seiner Punktzahl ein Jahr später in Beziehung. Wenn gemäß der Annahmen ein bestimmter Lehrer in einem Jahr 50 Punkte hatte und im nächsten 51, dann sollte sich eine Gerade ergeben, wenn man die Punktzahl aller Lehrer im ersten Jahr auf der x-Achse einträgt und das zweite Jahr auf der Y-Achse. |

Zur Ergänzung, das steht so nicht in der Quelle: ein Beispiel für drei Lehrer A, B C.

| Code: |

|

* * * C * * * A * * * B * * * * * * * * * * * * 0 1 2 3 4 5 6 7 8 9 |

Lehrer D, E und F, die weit jenseits der Geraden liegen, hätten sich von einem Jahr zum nächsten stark verbessert oder verschlechtert.

| Rubinstein hat folgendes geschrieben: |

Tatsächlich sieht der scatterplot ganz anders aus:

Die Leistung eines Lehrer in zwei Jahren korreliert nur schwach. (0,3) Heißt auf deutsch: dieses Jahr ein guter Leher, nächstes Jahr ein schlechter. Letztlich ist das Modell kaum besser als ein Zufallsgenerator. Unter den 18 000 Lehrer waren 707 Anfänger, die nach Annahme 3) am meisten Verbesserung zeigen müßten. Auch hier konnte Rubinstein keinen Effekt finden:

Weiter gab es Lehrer, die zwei oder mehr Fächer unterrichtet haben. Die Daten liegen getrennt nach Fächern vor. Nun könnte man meinen, daß ein guter Lehrer immer ein guter Lehrer ist, egal ob er gerade Mathe oder Englisch oder Kunst unterrichtet. Auch das findet sich nicht in den Daten.

Hmm, vielleicht kann ein Lehrer als Mathelehrer gut sein, und schlecht als Sprachlehrer. Aber sollte man nicht wenigstens annehmen können, daß ein guter Mathelehrer gut ist, egal welche Jahrgangsstufe er unterrichtet?

Auch nichts. Noch kurz O-Ton Rubinstein, darin fordert er dazu auf, obiges weiterzuerzählen. Aye, sir. I’ve never asked the people who read my blog to do this before since I prefer that it happen spontaneously, but I’d ask for you to spread the word about this post. Tweet it, email it, post it on Facebook. Whatever needs to happen for this to go ‘viral,’ I’d appreciate it. I don’t do this for money or for personal glory. I do it because I can’t stand when people lie and teachers, and yes those teachers’ students, get hurt because of it. I write these posts because I can’t stand by and watch it happen anymore. http://garyrubinstein.teachforus.org/2012/02/26/analyzing-released-nyc-value-added-data-part-1/ |

Wenn Rubinstein die Daten gefälscht hat, wäre das ein kleiner Skandal. Wenn er sie nicht gefälscht hat, dann ist VAM nur ein Pseudozufallszahlengenerator. Und der größere Skandal, daß so etwas keine Konsequenzen hat. Ein grober Fehler seitens Rubinstein wäre natürlich auch denkbar.

Den aktuellen Stand der Debatte kenne ich nicht. Bei Wikipedia heißt es:

| Wickipedia hat folgendes geschrieben: |

| Value-added modeling

Critics say that the use of tests to evaluate individual teachers has not been scientifically validated, and much of the results are due to chance or conditions beyond the teacher's control, such as outside tutoring. Research shows, however, that differences in teacher effectiveness as measured by value-added of teachers are associated with very large economic effects on students. https://en.wikipedia.org/wiki/Value-added_modeling |

Und nun?

Was soll man glauben, wem soll man glauben?

Das zeigt das Problem hinter der "Modelliererei". Wenn Schüler, Eltern, Kollegen oder die Schulaufsicht einzelne Lehrer in Alltagssprache beurteilen, dann kann jeder mitreden und sagen: "Unfug!" oder"Stimmt!". Wird das Urteil aber einem undurchsichtigen Modell überlassen, ist es schnell vorbei damit, daß jeder mitreden kann.

—

@smallie

bei deinem letzten Post musste ich - als ich ihn damals gelesen hab - an die Rentenformel denken.

Und wie Hans Eichel die Erklärung der Formel in einer Fernsehsendung nicht auf die Reihe bekommen hat....

naja, mehr wohl später

jetzt meine Frage an euch:

Ist die Erschaffung unserer eigenen Behüter~Götter~Kinder jetzt offiziell?

die Technologische Singularität

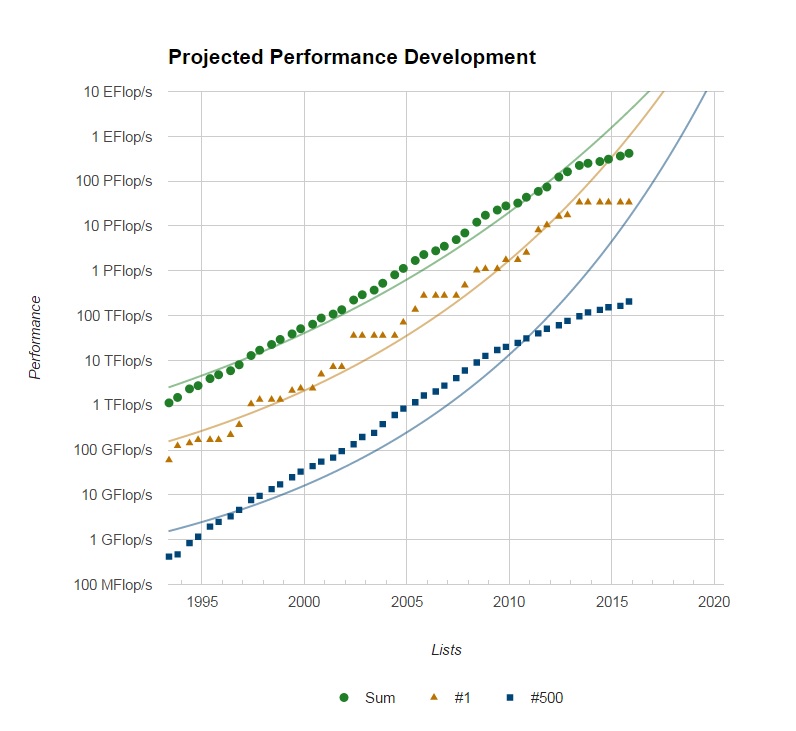

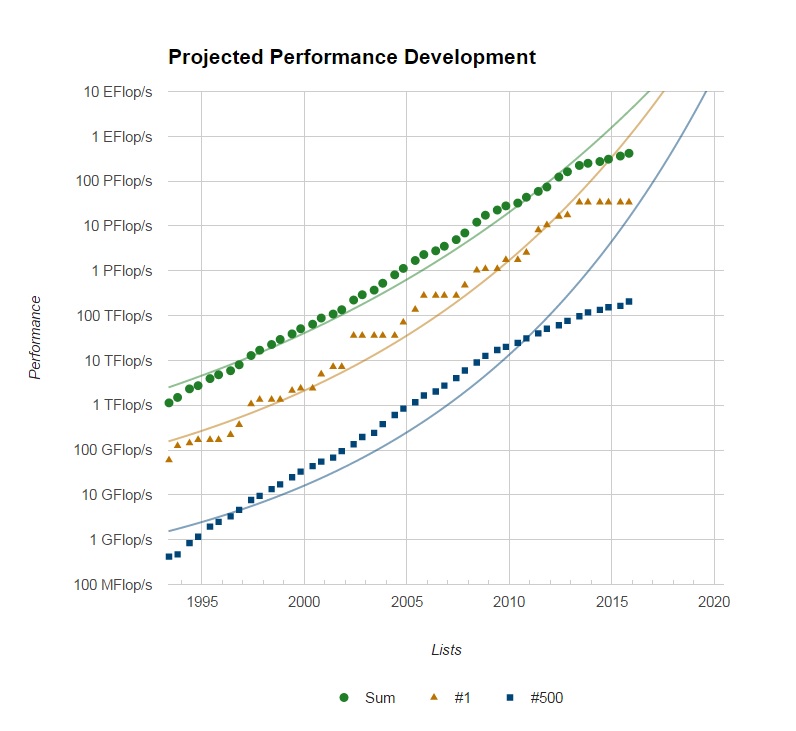

http://www.top500.org/statistics/perfdevel/

als ich das letzte Mal drauf geschaut hab, war die Prognose noch linear??!!!

dürfen wir nächsten Monat einen immensen Schub an Performance auf der Liste erwarten; z.B. wegen der neuen KI/deeplearning-Chips von Nvidia Tesla P100

—

| göttertod hat folgendes geschrieben: |

|

jetzt meine Frage an euch: Ist die Erschaffung unserer eigenen Behüter~Götter~Kinder jetzt offiziell? die Technologische Singularität [...] dürfen wir nächsten Monat einen immensen Schub an Performance auf der Liste erwarten; z.B. wegen der neuen KI/deeplearning-Chips von Nvidia Tesla P100 |

Wo siehst du denn überhaupt einen signifikanten Zusammenhang zwischen der Performance bei Gleitkommaoperationen und dem was Zukunftspropheten unter https://de.wikipedia.org/wiki/Technologische_Singularit%C3%A4t sich vorstellen ?

Ich sehe direkt strukturell gar keinen. Der einzige ist, dass zur Simulation von Strukturen welche möglichwerweise sowas ergeben könnten, auf der Basis herkömmlicher IT sehr viel Rechenpower benötigt wird.

—

| göttertod hat folgendes geschrieben: |

| jetzt meine Frage an euch:

Ist die Erschaffung unserer eigenen Behüter~Götter~Kinder jetzt offiziell? die Technologische Singularität |

Mal sehen. Die Kernfrage scheint mir zu sein, wieviel Rechenleistung ein Gehirn erbringt.

In ErWins Link heißt es:

| Zitat: |

| Hans Moravec bezifferte die Rechenleistung des Gehirns auf 100 Teraflops, Raymond Kurzweil auf 10.000 Teraflops. |

Zu den Flops gleich noch was.

Ich komme auf eine andere Zahl. Angemerkt sei, daß ich die Funktionsweise neuronaler Netze schamlos auf Gehirne übertrage.

Wir haben ungefähr 80 000 000 000 Gehirnzellen. Von denen sind meines Wissens etwa je 1000 miteinander verdrahtet. Diese feuern mehrmals in der Sekunde. Wie oft? Hmm. Gehirnwellen von Alpha bis Gamma haben Frequenzen von 5 bis über 30 Hz. Die Trägheit des Auges läßt uns Einzelbilder spätestens bei 24 oder 25 Bildern pro Sekunde nicht mehr erkennen. Ich bin konservativ und nehme 16, die Bildrate bei Standard-8 (kam vor Super-8 ).

- 1000 verbundene Neuronen

80 * 10^12 Neuronen (80 Tera)

16 Schaltvorgänge pro Sekunde

======================

10^18 Operationen (1 Exa)

Nicht berücksichtigt ist dabei das Drumherum in einem Computerprogramm: Schleifenindizes hochzählen, Programm-Ablaufsteuerung und Wartezyklen des Prozessors, bis die gewünschten Daten aus dem RAM endlich im Register steht. Das sollte aber größenordnungsmäßig nicht viel ausmachen.

Zum Vergleich:

- Moravec: 100 * 10^12 (100 TeraFlops)

Kurzweil: 10 * 10^15 (10 PetaFlops)

Moravecs Zahl erscheint mir unplausibel, denn sie liegt bei der Gesamtzahl der Gehirnzellen und berücksichtigt nicht einmal, daß diese mehrmals pro Sekunde schalten. Kurzweils Zahl liegt um eine Faktor 100 unter meiner.

Ein möglicher Grund: Echte Gehirnzellen feuern nicht immer. In einem neuronalen Netz werden aber die Signale der Neuronen berechnet, egal ob sie feuern oder nicht.

Fazit: keines. Erstmal abwarten, ob noch jemand einen Fehler in meiner Dreikäsehochrechnung findet.

| göttertod hat folgendes geschrieben: |

als ich das letzte Mal drauf geschaut hab, war die Prognose noch linear??!!!

http://www.top500.org/statistics/perfdevel/ |

Das ist zweideutig. Meinst du die durchgezogenen Linien oder gepunkteten?

Die durchgezogenen sehen mir nach Murks aus. Die Y-Achse ist logarithmisch. Ein exponentielle Wachstum ergibt im Diagramm eine Gerade. Die durchgezogenen Linien sind aber selbst exponentiell, beschreiben also ein überexponentielles Wachstum. Ermm?

| göttertod hat folgendes geschrieben: |

| dürfen wir nächsten Monat einen immensen Schub an Performance auf der Liste erwarten; z.B. wegen der neuen KI/deeplearning-Chips von Nvidia Tesla P100 |

Klingt gut. So einen will ich auch mal haben, wenn ich groß bin.

Langfristig erscheinen mir aber echte KI-Maschinen vielversprechender, so wie Bliss sie weiter oben erwähnt hat.

—

| smallie hat folgendes geschrieben: | ||

Mal sehen. Die Kernfrage scheint mir zu sein, wieviel Rechenleistung ein Gehirn erbringt. |

Dein Schein trügt

Es ist schon nicht besonders sinnig überhaupt die "Rechenleistung" des Hirns in flops zu "messen" und noch viel unsinniger aus der Relation der flops in der IT zu den "flops" des Hirns eine Korrelation in Bezug auf Intelligenz ableiten zu wollen.

Wie auch in wikipedia erwähnt liegt der Kern bei (künstlichen) neuronalen Netzen in deren Struktur und der Art wie man das Netz mit "Lerninhalten füttert".

Flops sind als Mass nur insoweit relevant, als dass die zugrundeliegende "normale" Hardware einfach eine gewisse Verarbeitungsgeschwindigkeit benötigt, damit man in praktikabler Zeit das Netz lernen lassen kann.

Wenn jemand aus den flops von Hardware Rückschlüsse auf die Intelligenz zieht, dann erscheint mir das so, wie wenn jemand aus der Tatsache dass sein Golf 110 PS hat schließt, dass deshalb eine hohe Ähnlichkeit seines Fahrzeuge bzgl. der Fortbewegungsart zu einer Herde von 110 Pferden bestehe.

—

| Er_Win hat folgendes geschrieben: | ||||

Dein Schein trügt |

Ja. Vor allem weil ich unbedacht verbalen Etikettenschwindel betrieben habe. Wenn du genau hinschaust, dann steht da eigentlich eine Überschlagsrechnung, wieviel Rechenleistung die Emulation eines Gehirns mittels eines einfachen neuronalen Netzes auf einer Von-Neumann-Maschine bräuchte.

Siehe auch:

| smallie hat folgendes geschrieben: |

| Angemerkt sei, daß ich die Funktionsweise neuronaler Netze schamlos auf Gehirne übertrage. |

| Er_Win hat folgendes geschrieben: |

| Es ist schon nicht besonders sinnig überhaupt die "Rechenleistung" des Hirns in flops zu "messen" und noch viel unsinniger aus der Relation der flops in der IT zu den "flops" des Hirns eine Korrelation in Bezug auf Intelligenz ableiten zu wollen. |

Naja, irgend eine grobe Zahl wird es geben müssen - selbstverständlich abhängig von der Rechnerarchitektur. Außer du bist der Meinung, Intelligenz aus dem Rechner ginge prinzipiell nicht. Wahrscheinlich bist du sogar dieser Meinung, nur hast du noch keine Argumente in dieser Richtung gebracht.

| Er_Win hat folgendes geschrieben: |

| Wie auch in wikipedia erwähnt liegt der Kern bei (künstlichen) neuronalen Netzen in deren Struktur und der Art wie man das Netz mit "Lerninhalten füttert". |

Da kann ich nicht ganz folgen, was du meinst. Heißt es doch im Link:

- Daraus ergaben sich typische Eigenschaften neuronaler Netze, die gleichermaßen für natürliche, wie für künstliche „neuronale Systeme“ gelten.

| Er_Win hat folgendes geschrieben: |

| Flops sind als Mass nur insoweit relevant, als dass die zugrundeliegende "normale" Hardware einfach eine gewisse Verarbeitungsgeschwindigkeit benötigt, damit man in praktikabler Zeit das Netz lernen lassen kann. |

Echte Intelligenz lernt doch ständig.

| Er_Win hat folgendes geschrieben: |

| Wenn jemand aus den flops von Hardware Rückschlüsse auf die Intelligenz zieht, dann erscheint mir das so, wie wenn jemand aus der Tatsache dass sein Golf 110 PS hat schließt, dass deshalb eine hohe Ähnlichkeit seines Fahrzeuge bzgl. der Fortbewegungsart zu einer Herde von 110 Pferden bestehe. |

110 Pferde mit 1 PS können soviel Arbeit verrichten, wie 1 Pferd mit 110 PS.

1 Pferd mit 110 PS läuft aber schneller als eine Herde von 110 Pferden mit 1 PS.

Außer das Pferd hinkt so wie dein Vergleich.

—

Zu welchen Dingen künstliche Intelligenz noch fähig sein wird - da werden sich wohl noch so manche wundern. Wer da kein stabiles Vertrauen in unsere Gesellschaft hat, wird es möglicherweise mit der Angst zu tun bekommen. In welcher Phase die KI steckt, kann man gut mit dem Humangenomprojekt (Entschlüsselung der menschlichen Gene) vergleichen. In den ersten Jahren des Projekts wurden - im Verhältnis gesehen - nur wenige Basenpaare sequenziert. In den letzten Jahren aber ist die Anzahl rapide in die Höhe geschossen. Warum? Weil die Rechenleistung und -kapazität der dafür verwendeten Computer in die Höhe schoss. Mit jedem einzelnen Bit mehr verdoppelt sich die Anzahl der Speicherkapazität.

Wir sind in einer Phase massiver Parallelisierung - insbesondere mittels Grafikprozessoren (Cuda etc.). Aber auch neuromorphe Prozessoren wie 'TrueNorth', die den Neocortex nachbilden (256 Millionen Synapsen) sind am Vormarsch. Mit Deep Learning fängt man nun langsam an zu begreifen, wie man das Hirn simulieren kann.

Und dennoch mache ich mir um den Arbeitsmarkt relativ wenige Sorgen. Ja, es wird ein großer Teil automatisiert werden und die Berufslandschaft wird sich stark verändern. Aber die Menschen werden es machen, wie sie es immer getan haben - sie werden sich anpassen - sie werden sich woanders nützlich machen.

Was mir z.B. Sorgen macht, sind die Dinge, derer sich Menschen nicht so bewusst sind - die Dinge, die schleichend und durch die Hintertür kommen.

—

Angeregt durch einen Kommentar in der SZ, platziere ich den Aufsatz von Robert Epstein mal hier an dieser Stelle.

| Zitat: |

| The empty brain

Your brain does not process information, retrieve knowledge or store memories. In short: your brain is not a computer [...] We don’t store words or the rules that tell us how to manipulate them. We don’t create representations of visual stimuli, store them in a short-term memory buffer, and then transfer the representation into a long-term memory device. We don’t retrieve information or images or words from memory registers. Computers do all of these things, but organisms do not. [...] Forgive me for this introduction to computing, but I need to be clear: computers really do operate on symbolic representations of the world. They really store and retrieve. They really process. They really have physical memories. They really are guided in everything they do, without exception, by algorithms. Humans, on the other hand, do not – never did, never will. Given this reality, why do so many scientists talk about our mental life as if we were computers? [...] The information processing (IP) metaphor of human intelligence now dominates human thinking, both on the street and in the sciences. There is virtually no form of discourse about intelligent human behaviour that proceeds without employing this metaphor, just as no form of discourse about intelligent human behaviour could proceed in certain eras and cultures without reference to a spirit or deity. The validity of the IP metaphor in today’s world is generally assumed without question. But the IP metaphor is, after all, just another zelig: neben den vorangegangenen, zeitgemäß dominierenden metaphor – a story we tell to make sense of something we don’t actually understand. And like all the metaphors that preceded it, it will certainly be cast aside at some point – either replaced by another metaphor or, in the end, replaced by actual knowledge. |

https://aeon.co/essays/your-brain-does-not-process-information-and-it-is-not-a-computer

Endlich, möchte ich sagen, ein Aufsatz, der meiner Skepsis entspricht. Und sogar eine unverhoffte Nebenbemerkung zu einem Thema macht, das ich im Verdacht habe, der Grund für die allermeisten Missverständnisse in Diskussionen über die Beschaffenheit der Wirklichkeit zu sein: Der Einzigartigkeit jeder Entität, die dann letztlich die Rede von Identität hinfällig macht. Und die weitreichenden Folgen aus dieser Überlegung.

—

@ zelig

| Zitat: |

| [...]

Forgive me for this introduction to computing, but I need to be clear: computers really do operate on symbolic representations of the world. They really store and retrieve. They really process. They really have physical memories. They really are guided in everything they do, without exception, by algorithms. Humans, on the other hand, do not – never did, never will. Given this reality, why do so many scientists talk about our mental life as if we were computers? [...] |

Ich habe mir nur das genommen, weil es da am offenichtlichsten ist:

Das ist in meinen Augen purer Blödsinn. Betrachte - gar nicht mal uns, sondern irgend ein anderes Tier, das vor einer Aufgabe steht, die eine Reaktion auf die momentane Umwelt beinhaltet: Wir wissen, dass da Umweltdaten erfasst und elektrisch an eine Zentrale gesand werden. Sie werden auch offensichtlich "richtig" verarbeitet, sonst wäre die entsprechende Tierart schon lange ausgestorben. Dabei wissen wir, dass dieses Tier nicht nur gegenwärtige Bilder verarbeiten - sie greifen auch auf Erinnerungen zurück, die, weil nur elektrische Signale in dieser Zentrale ankommen, da irgendwie gespeichert sein müssen - frag mich nicht wie.

Ich könnte das, was wir hier diskutierend veranstalten, genauso auseinandernehmen, es käme aber auch nichts anderes dabei heraus, bis auf die Tatsache, dass die Information, die zwischen uns ausgetausch wird, auf ihrem Weg mehrfach kodiert wird.

Dieses Zitat wäre nur dann sinnvoll, wenn man unter Computer nur ein Gerät mit einer Von-Neumann-Architektur verstünde. Aber welcher Mensch, der Lebewesen als Computer beschreibt, tut das?

Es handelt sich um eine funktionale Beschreibung von Tieren (Pflanzen funktionieren analog), bei der wir zur Zeit weder den Anspruch erheben, die Hardware genau verstanden zu haben, noch zu wissen, wie die Datenpseicherung genau funktioniert. Allenfalls einzelne Allgorithmen lassen sich über Versuche in ihrer Funktion ganz gut beschreiben. Was wir aber feststellen können, ist, dass da Daten gespeichert und verarbeitet werden. Und so ein Ding, in dem das passiert, nennt man Computer.

Wir hatten diese Diskussion übrigens irgendwann schon einmal.

—

| fwo hat folgendes geschrieben: |

| Dieses Zitat wäre nur dann sinnvoll, wenn man unter Computer nur ein Gerät mit einer Von-Neumann-Architektur verstünde. Aber welcher Mensch, der Lebewesen als Computer beschreibt, tut das? |

Hat Ray Kurzweil plötzlich keine Anhänger mehr? Auf welchem Paradigma fußt das Human Brain Project? Habe ich Steven Pinkers "Denken" so falsch in Erinnerung? Wurden im FGH noch nie transhumanistische Visionen incl. Uploadmöglichkeiten des Bewußtseins auf neue Hardware diskutiert? Sorry, das grenzt schon an Realitätsverweigerung. : )

output generated using printer-friendly topic mod. Alle Zeiten sind GMT + 1 Stunde

Powered by phpBB © 2001, 2005 phpBB Group