—

| fwo hat folgendes geschrieben: |

|

Aber ich gehe davon aus, dass Du Dir die Schachregel dabei nicht selbst ausgedacht hast oder? |

Da stossen wir mit dem Schach-Beispiel an Grenzen. Wer "Schach" lernt, indem er sich einfach eigene Regeln ausdenkt, der lernt ja nicht Schach. Wer dagegen eine Fähigkeit wie Schreiben oder Musizieren erlernt und sich dafür seine eigenen Regeln ausdenkt, mit den Füssen schreibt oder das Instrument in völlig falscher Haltung spielt, kommt eventuell doch ans Ziel.

—

| fwo hat folgendes geschrieben: | ||

Aus Deinem Link:

|

fein, dass du dir jetzt selbst widersprichst

| fwo hat folgendes geschrieben: |

| Auch der Mensch fängt nichts von selbst an ... |

—

| Kramer hat folgendes geschrieben: | ||

Ich weniger, dafür habe ich zu sehr das Gefühl, das alles schon einmal erlebt zu haben. Wenn man in den 80er Jahren so manche Nacht damit verbracht hat, den Streitgesprächen zwischen passionierten Schachspielern und Informatikstudenten zu lauschen und ein Argument der Informatiker darin bestand, dass es demnächst Speichermedien geben wird, auf denen man die Bibel komplett speichern kann - also auch umfangreiche Eröffnungsbibliotheken - dann ist man angesichts dessen, was so alles folgte, nicht mehr erstaunt. |

Die Diskussionen kenne ich auch, allerdings war damals eigentlich jedem Informatiker klar, dass da beim Schach nicht die Maschine, sondern der Programmierer mit "unerlaubten Hilfsmitteln" gegen den Menschen spielte. Das ist bei AlphaGo anders. Das Programm stellt während seiner Lernphase auch keine Eröffnungsbibliothek her, sondern entwickelt - bisher ohne die Möglichkeit abstrakten Denkens - auf der Basis seiner Spielerfahrung einen eigenen Maßstab für gewinnträchtige Züge. Ich vermute, dass wir hier in der Struktur des Verfahrens ganz dich bei dem sind, wie wir die Entscheidungskompetenz gewinnen, die wir Intuition nennen, bei der wir uns der einzelnen Erfahrungen, auf denen unsere Entscheidung beruht, auch nicht bewusst sind.

—

| fwo hat folgendes geschrieben: |

| Ich vermute, dass wir hier in der Struktur des Verfahrens ganz dich bei dem sind, wie wir die Entscheidungskompetenz gewinnen, die wir Intuition nennen, bei der wir uns der einzelnen Erfahrungen, auf denen unsere Entscheidung beruht, auch nicht bewusst sind. |

Vermuten kann man viel: die "GO-Welt" ist formal mathematisierbar und genau das ist der wesentliche Punkt bei system-vergleichender Betrachtung bzw. Zuschreibung.

Man kann dem Bewußtsein oder Leben allgemein "unterstellen" dass es sich auch gesamt formal mathematisieren läßt, das ist so ähnlich wie der Glauben an die - bis jetzt nicht gefundene - https://de.wikipedia.org/wiki/Weltformel

Da spaltet sich die Wissenschaft - und noch mehr die Populär"wissenschaft" - in die zwei Lager: Die einen, die so tun, als ob die eigentlich schon fast gefunden wäre und die anderen, die Zweifel anmelden, sowas überhaupt jemals anfinden zu können.

—

| cortano hat folgendes geschrieben: | ||||||

fein, dass du dir jetzt selbst widersprichst

|

Auch wenn Du es nicht merkst, es ist nicht wirklich ein Widerspruch, weil es unterschiedliche Beschreibungsebenen für das menschliche Verhalten gibt. Auf der subjektiven Ebene sind wir es natürlich "selbst" die etwas anfangen. Aber wir tun das in den seltensten Fällen aus dem Bewusstsein, in der Regel "werden wir angefangen" und rationalisieren das dann als eigenen Entschluss. Blätter mal zurück, was ich da zum Thema Motivation geschrieben habe. In der normalen Kommunikation wird zwar hauptsächlich die subjektive Ebene benutzt, auch in Wiki, aber Du darfst Dich gerne mit einem Psychologen Deiner Wahl über dieses Thema unterhalten - ich gehe davon aus, dass er Dir da sehr ähnliches erzählen wird, wie das, was ich es jetzt gerade geschrieben habe.

—

| fwo hat folgendes geschrieben: |

|

Auch wenn Du es nicht merkst ... |

Auch wenn du es nicht merkst: Es ist nicht so, dass die hier im Forum verbreitete und nach ca. 2000 insbesondere von Singer, Roth, Metzinger verbreitete Ansicht zu Neurowissenschaften einen allgemeinen Konsens darstellen würden, vorallem nicht im englischsprachigen Raum aber auch im deutschsprachigen nicht.

Man kann sicher gewisse Dinge ausblenden uns so tun, als wären die Ergebnisse schon vorhanden, die ubiquitäre Analogien wie die deinigen rechtfertigen.

| Zitat: |

| Ein weiteres Problem ist, daß häufig kein theoretischer Konsens darüber besteht, wie bestimmte psychische Grundfunktionen (z.B. visuelle Aufmerksamkeit) in Teilfunktionen und zugehörige Verarbeitungssysteme zerlegt werden sollen. Deshalb dürfte eine Weiterentwicklung der Disziplin, die sich alleine auf die Meßmethoden bezieht, keinen entscheidenden Fortschritt bringen, wenn es nicht gleichzeitig gelingt, angemessene Theorien mit plausiblen funktionalen Zerlegungen in Teilleistungen und Verarbeitungssysteme zu formulieren sowie entsprechende experimentelle Paradigmen für ihre Überprüfung zu entwickeln. |

http://www.spektrum.de/lexikon/neurowissenschaft/kognitive-neurowissenschaft/6578

—

| cortano hat folgendes geschrieben: | ||||

Auch wenn du es nicht merkst: Es ist nicht so, dass die hier im Forum verbreitete und nach ca. 2000 insbesondere von Singer, Roth, Metzinger verbreitete Ansicht zu Neurowissenschaften einen allgemeinen Konsens darstellen würden, vorallem nicht im englischsprachigen Raum aber auch im deutschsprachigen nicht. Man kann sicher gewisse Dinge ausblenden uns so tun, als wären die Ergebnisse schon vorhanden, die ubiquitäre Analogien wie die deinigen rechtfertigen.

http://www.spektrum.de/lexikon/neurowissenschaft/kognitive-neurowissenschaft/6578 |

Das ist ein netter Artikel den Du da verlinkt hast - ich weiß nur nicht, wo der spezielle Widerspruch zu mir oder step, zelig oder smallie liegen soll - wir sind ja hier auch nicht alle einer Meinung. Allerdings ist jeder von uns in der Lage, auf Nachfragen zu antworten und seine Aussage zu präzisieren, wenn man ihn bittet. Das ist so, weil es sich da um Meinungen handelt, die etwas mehr Hintergrund haben als einen eben gegoogelten oder einen Wikipedia-Artikel. Wikipedia wird hier z.B. von mir hauptsächlich benutzt, um sicherzustellen, dass wir gerade bei einem Begriff eine gemeinsame Basis haben, und ist nicht Quell meines Wissens (auch wenn ich immer wieder fasziniert bin, wieweit diese Enzyklopadie inzwischen geht).

Also: Man kann die Analogien benutzen, die ich benutze - ich bin auch nicht alleine damit. Man kann es auch nicht mögen, wenn ich das mache, und zelig hat auch schon begründet, warum er das nicht mag - ich fand die Begründung für mich nicht überzeugend, aber was zelig mir entgegenhält, ist immer mehr als ein "ey, das ist doch gar nicht autodidaktisch". btw: Du hast immer noch nicht begründet, warum es das nicht sein soll, und machst jetzt dafür ein neues allgemeines Fass auf, nachdem der Versiuch mit meinem Selbstwiederspruch in die Hose gegangen ist. Bleib doch mal beim Thema.

Was offensichtlich ist, ist, dass einige der Formulierungen, die hier gefallen sind, für Dich etwas zu abstrakt waren.

—

| fwo hat folgendes geschrieben: |

| btw: Du hast immer noch nicht begründet, warum es das nicht sein soll, und machst jetzt dafür ein neues allgemeines Fass auf, nachdem der Versiuch mit meinem Selbstwiederspruch in die Hose gegangen ist. Bleib doch mal beim Thema.

Was offensichtlich ist, ist, dass einige der Formulierungen, die hier gefallen sind, für Dich etwas zu abstrakt waren. |

wie bitte ?

| cortano hat folgendes geschrieben: |

| die "GO-Welt" ist formal mathematisierbar und genau das ist der wesentliche Punkt bei system-vergleichender Betrachtung bzw. Zuschreibung. |

aber glaub' doch was du möchtest, dann ist eben das alphaGO mit menschlicher Intuition "verwandt" und autodidaktisch und strukturell ist Neurocomputing aquivalent mit dem Gehirn als ganzes und somit "das Ding an sich"

Vielleicht war das doch zu abstrakt für dich:

| Zitat: |

| Entscheidend für den Ansatz der kognitiven Neurowissenschaft ist, daß die im Rahmen der funktionalen Zerlegung postulierten Teilsysteme der Informationsverarbeitung bestimmten Anteilen ihres materiellen Substrats, des Gehirns, zugeordnet werden. |

Den Hinweis auf Henry Markram in scientificamerican und die "Hundebeispiele" hast du offenbar weder verstanden/gelesen noch kommentiert...

Zuletzt bearbeitet von cortano am 19.12.2017, 19:29, insgesamt einmal bearbeitet

—

| cortano hat folgendes geschrieben: | ||||

wie bitte ?

|

Was ändert das jetzt an der Zuschreibung des Begriffes autodidaktisch für das Verhalten von AlphaGo?

—

| fwo hat folgendes geschrieben: |

|

Was ändert das jetzt an der Zuschreibung des Begriffes autodidaktisch für das Verhalten von AlphaGo? |

Das Attribut wird für Menschen verwendet. Aber wenn du für dich bereits eine isomorphe Abbildung auf eine formal mathematisierbare Struktur bewiesen hast, dann ändert das natürlich nichts

Solltest bei Gelegenheit auch mal Henry Markram darüber Bescheid sagen ...

Aber das wurde doch schon abgefrühstückt und Neues kommt von dir genauso wenig wie irgendein Verständnis in Bezug auf vielerlei Einwände. Man sollte dir einfach deinen "NP-vollständigen Glauben" lassen !

—

| cortano hat folgendes geschrieben: | ||

Das Attribut wird für Menschen verwendet. |

Stimmt auffällig - für die Vergangenheit. Das lag daran, dass es bisher keine Maschinen gab, von denen man sagen konnte, dass sie sich selbst Fertigkeiten aneigneten.

| cortano hat folgendes geschrieben: |

| Aber wenn du für dich bereits eine isomorphe Abbildung auf eine formal mathematisierbare Struktur bewiesen hast, dann ändert das natürlich nichts .... |

Du übersiehst etwas: Zwar ist Go prinzipiell formal beschreibbar, aber das Siegen nicht. Das irgendwie Spielen, die Regeln hat man der Maschine "erklärt". Aber dadurch gewinnt man nicht. Auch Du wirst nicht gewinnen, wenn man Dir die Regeln erklärt. Es geht hier um den Weg vom Neuling zum Sieger, der mit der Vokabel autodidaktisch genau richtig beschrieben ist - zumindest hast Du bisher inhaltlich nichts gebracht, was diese Beschreibung infrage stellt, außer, dass man dieses Wort nur für Menschen verwendet. Verwendete ist richtig.

—

| fwo hat folgendes geschrieben: |

|

Du übersiehst etwas: Zwar ist Go prinzipiell formal beschreibbar, aber das Siegen nicht. Das irgendwie Spielen, die Regeln hat man der Maschine "erklärt". Aber dadurch gewinnt man nicht. ........ |

Ich überlege gerade ob man rechthaberisches Schwurbeln auch formal beschreiben kann

Die "fwoautodidaktik" nennt die Fachwelt aber deep-learning und das ist auch gar nicht prinzipiell neu - das neue ist viel eher die Bewältigung von bigdata !

| Zitat: |

|

Das "Spielpolitik"-Netz (policy network), das nach den jeweils lohnenden Zügen sucht, trainierten sie anhand von 30 Millionen Spielzügen aus einer Datenbank von Partien fortgeschrittener Spieler. Ihr System lernte dabei vorherzusagen, welche Spielzüge angesichts einer gegebenen Stellung am wahrscheinlichsten durchgeführt werden. Mit Hilfe dieses Netzes entwickelten sie anschließend eine rudimentäre Go-KI, die sie in leicht unterschiedlichen Versionen gegen sich selbst antreten ließen. Das Netz verfeinerte dadurch seine Vorhersagen über die Wahrscheinlichkeit von Zügen, indem es berücksichtigte, ob seine Vorhersagen zum Spielgewinn führten oder nicht. Bei diesem "reinforcement learning" genannten Lernverfahren werden Entscheidungen nachträglich belohnt, wenn sie sich als günstig herausstellen. Das "Werte"-Netzwerk (value network) trainierten sie ebenfalls anhand von 30 Millionen Partien darauf, für eine gegebene Stellung vorherzusagen, ob eher Weiß oder Schwarz gewinnt |

Würden Kleinkinder formal-aquivalent so laufen lernen, bräuchten sie, wie kramer schon ironisch erwähnt hat, mehrere hundert Jahre dazu ...

Ich glaube ich erwähnte bereits, dass durch die deeplearning Erfolge eine Art KI-Hype 2.0 ausgelöst wurde

—

| cortano hat folgendes geschrieben: | ||||

Ich überlege gerade ob man rechthaberisches Schwurbeln auch formal beschreiben kann Die "fwoautodidaktik" nennt die Fachwelt aber deep-learning und das ist auch gar nicht prinzipiell neu - das neue ist viel eher die Bewältigung von bigdata !

Würden Kleinkinder formal-aquivalent so laufen lernen, bräuchten sie, wie kramer schon ironisch erwähnt hat, mehrere hundert Jahre dazu ... Ich glaube ich erwähnte bereits, dass durch die deeplearning Erfolge eine Art KI-Hype 2.0 ausgelöst wurde |

Du erzählst uns hier nichts Neues - der Artikel über den Vorläufer von AlphaGo Zero war hier verlinkt und wurde auch diskutiert. Aber unabhängig davon, wie die ihre Methode nun nennen, beim Nachfolgemodell ist sie übrigens leicht anders, verstehe ich die Mühe, die Du dir da machst nicht.

Du brauchst doch bloß zu zeigen, dass es falsch ist, dass die Maschine die Fähigkeit zum Erkennen der siegversprechenden Züge durch eigenen Aktionen selbst erlangt hat.

—

| step hat folgendes geschrieben: | ||||||

Sehe ich ähnlich. Ich hatte die Frage gestellt, weil ich befürchtete, Du würdest die starke Rolle der Statistik ins Feld führen für das "Besondere" der biologischen NNs. Aber die Befürchtung hatte ich wohl zu unrecht. |

Der Hintergrund meiner Bemerkung:

| Zitat: | ||||

| Machine learning and statistics

Aleks pointed me to this article by Brendan O’Connor comparing the fields of machine learning and statistics. Comments

http://andrewgelman.com/2008/12/03/machine_learnin/ |

| step hat folgendes geschrieben: |

| Das Besondere an neueren, leistungsfähigeren KIs ist ja nicht so sehr die Funktion des einzelnen Neurons, die Du beschreibst, oder die Zahl und Vernetzung der Neuronen, sondern die Organisation in Schichten unterschiedlich hoher Systemebene, wobei auf jeder Ebene für sich ähnliche Prozesse - etwa die von Dir beschriebene Parametervariation - auftreten. Und ich denke tatsächlich wie Du, daß (1) und künstliche NNs nicht nur auf neuronaler Ebene, sondern auch in bezug auf den Schichtenaufbau - das eigentlich Geniale - ähnlich sind. |

Stimmt. Den Schichtenaufbau habe ich in meiner Darstellung zu sehr vernachlässigt, dabei ist er ganz wesentlich für praktische Aufgaben, die über Spielzeugprobleme hinausgehen.

Die fehlenden Schichten waren Grund für die Zweifel von Marvin Minsky und Seymour Papert in ihrem Perceptrons-Buch aus dem Jahr 1969, mit neuronalen Netzen könne man komplexe Probleme lösen.

| step hat folgendes geschrieben: |

| Ohne im Einzelnen auf Dein Modell einzugehen: Wir müssen ja zwei Mechanismsen betrachten - (1) das Lernen im individuellen Gehirn, und (2) das evolutionäre Lernen. Die Feedbackmechanismen und -zeiten sind ja sehr unterschiedlich. Mir geht es erstmal nur um (1). |

Ich ergänze um (1b):

Die unterschiedlichen Feedbackmechanismen und -zeiten scheinen mir bereits eine Richtung anzudeuten, wie sich Bewußtsein ins Spiel bringen läßt.

| step hat folgendes geschrieben: |

| Nun zu Deiner These über (2) - meiner Ansicht nach fehlt bei der Evolution die Schichtenarchitektur. Kannst Du Deine Analogie trotzdem aufrechterhalten? Gengruppen, Arten, Ökosysteme ...? Hmm ... glaube ich eher nicht. |

Die Schichten entsprechen ziemlich gut den Ebenen der Selektion.

Von der algorithmischen Seite aus betrachtet:

| Zitat: | ||

| The Reasonable Effectiveness of the Multiplicative Weights Update Algorithm

Hard to believe Sanjeev Arora and his coauthors consider it “a basic tool [that should be] taught to all algorithms students together with divide-and-conquer, dynamic programming, and random sampling.” Christos Papadimitriou calls it “so hard to believe that it has been discovered five times and forgotten.” It has formed the basis of algorithms in machine learning, optimization, game theory, economics, biology, and more. What mystical algorithm has such broad applications? Now that computer scientists have studied it in generality, it’s known as the Multiplicative Weights Update Algorithm (MWUA). Procedurally, the algorithm is simple. I can even describe the core idea in six lines of pseudocode. You start with a collection of objects, and each object has a weight.

https://jeremykun.com/2017/02/27/the-reasonable-effectiveness-of-the-multiplicative-weights-update-algorithm/ |

—

| fwo hat folgendes geschrieben: |

|

Du brauchst doch bloß zu zeigen, dass es falsch ist, dass die Maschine die Fähigkeit zum Erkennen der siegversprechenden Züge durch eigenen Aktionen selbst erlangt hat. |

Aber klar hatte die Maschine selbst die Idee durch schiere Rechenpower und unter Anwendung einer schon lange bekannten Netztopologie zum Erfolg zu gelangen und auch auf die Verfeinerung bei AlphaGO zero kam die KI dann ganz von selbst - eben voll der Autodidakt !

Das gleitet mir jetzt dann doch vom Sinngehalt etwas zu sehr in Richtung der "uwebus-Gravitation" ab...

Aber gerne darfst du aus den vielen verlinkten Quellen deine ganz persönlichen Schlüsse ziehen.

—

| smallie hat folgendes geschrieben: | ||

|

Die Schichten entsprechen ziemlich gut den Ebenen der Selektion. Von der algorithmischen Seite aus betrachtet:

|

Bist du sicher, dass du verstanden hast, worum es bei dem geht, was du da verlinkt hast ? Und wenn ja, wo kommen da Schichten und wo kommt da Bewußtsein ins Spiel ?

Es geht bei MWUA um Optimierungsprobleme so zB:

https://de.wikipedia.org/wiki/Konvexe_Optimierung

https://de.wikipedia.org/wiki/Lineare_Optimierung

https://de.wikipedia.org/wiki/Semidefinite_Programmierung

Aber vielleicht habe ich etwas nicht verstanden und du zeigst mir beispielhaft, wo es da um Bewußtsein und Schichten statt "nur" um effiziente Optimierungsalgorithmen geht.

—

| cortano hat folgendes geschrieben: | ||

Aber klar hatte die Maschine selbst die Idee durch schiere Rechenpower und unter Anwendung einer schon lange bekannten Netztopologie zum Erfolg zu gelangen und auch auf die Verfeinerung bei AlphaGO zero kam die KI dann ganz von selbst - eben voll der Autodidakt ! Das gleitet mir jetzt dann doch vom Sinngehalt etwas zu sehr in Richtung der "uwebus-Gravitation" ab... Aber gerne darfst du aus den vielen verlinkten Quellen deine ganz persönlichen Schlüsse ziehen.  |

Alle Achtung. Wo holst Du nur diesen zusätzlichen Blödsinn her? Denkst Du Dir den ganz alleine aus?

Wo steht, dass ein Autodidakt selbst auf die Idee gekommen sein muss? Dem kann auch einfach jemand gesagt haben: Mach Dich schlau - das ist auch etwas, was in der Realität völlig normal ist.

Du bist einfach nur dabei, das Wort autodidaktisch mit zusätzlichem Inhalt so aufzuladen, dass es nur für Menschen passt. Kannst Du ja machen, wenn Du das brauchst, aber sinnvoll erscheint mir das nicht.

Es geht bei dieser Aussage einfach nur darum, dass das Wissen, wie ein gewinnversprechender Zug aussieht, von keinem Programmierer da reingesteckt wurde, sondern durch Aktivitäten der Maschine entstanden ist. Die Fähigkeit, den gewinnversprechenden Zug zu erkennen, hat die Maschine also selbst entwickelt.

Solange Du nicht zeigen kannst, dass diese Aussagen in ihrer ganz normalen Bedeutung falsch sind, ist der ganze Bohei, den Du hier veranstaltest, für die Katz.

—

| fwo hat folgendes geschrieben: |

| Denkst Du Dir den ganz alleine aus? |

Nein, ich bin eine KI - der Blödsinn wurde mir eingegeben (sic) !

Anleitung zur Evaluierung von "intelligenter" Software: Man nehme ein Spiel, das man nicht kennt und eine software-ermittelte ° Gewinnstrategie, die man auch nicht kennt, übersetze die Überschrift aus einem englischen Fachartikel unpassenderweise mit "autodidaktisch" statt "selbst-lernend" und reite dann penetrant darauf herum, dass die Semantik, welche bei "autodidaktisch" nachweislich auf Menschen gemünzt zu verstehen ist, sich durch diese brillante Rhetorik nun auch vollumfänglich treffed für die unbekannte deeplearning Software eigne. Chapeau !

Schön, dass wir darüber gesprochen haben

°) nachträglich auf fwos Hinweis angepasst

Zuletzt bearbeitet von cortano am 20.12.2017, 11:53, insgesamt 2-mal bearbeitet

—

"Finden Sie nicht, dass Ihr Diskussionsgegner zumindest einige ihrer Standpunkte widerlegt hat?"

"Doch schon, aber das war nicht einvernehmlich."

—

| cortano hat folgendes geschrieben: | ||

Nein, ich bin eine KI ! Anleitung zur Evaluierung von "intelligenter" Software: Man nehme ein... eine softwareunterstützte Gewinnstrategie, die man auch nicht kennt, ... |

Da genau liegt Dein Fehler: Es gibt keine softwareunterstützte Gewinnstrategie, sonder es gibt eine Gewinnstrategie dieser Software - das ist der große Unterschied zu den Schachprogrammen, den Du offensichtlich nicht verstanden hast.

btw: im Englischen steht da self-taught. To teach bedeutet nur ganz selten lernen. Verdrehst Du jetzt schon die einfachsten Vokabeln?

Also als KI taugst Du nichts.

—

| Kramer hat folgendes geschrieben: |

| "Finden Sie nicht, dass Ihr Diskussionsgegner zumindest einige ihrer Standpunkte widerlegt hat?"

"Doch schon, aber das war nicht einvernehmlich." |

—

ok - softwareunterstützte Gewinnstrategie ist nicht treffend, das stimmt ! Es müsste softwareermittelte Gewinnstrategie heissen.

—

Die ganze Sci-Fi-ktionäre Propagandashow um deeplearning ist vermutlich hauptsächlich ein gelungener Marketing-Gag, wobei ich die enormen Fortschritte bei der Mustererkennung nicht in Abrede stellen will. Aber dafür ist GO gar kein so gutes Beispiel weil das Gewinn-Problem eher "flach" und formalisierbar ist. Das Problem war hauptsächlich der grosse ca. 10^170 Möglichkeitsraum an Positionen.

Und ich selbst finde das ganze sehr spannend, vorallem auch wenn man sich über die möglichen Einsatzgebiete Gedanken macht und auch eventueller Fehler die dann unangenehme Folgen haben.

| Zitat: |

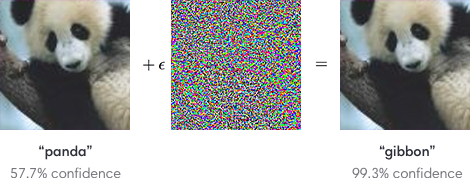

| Since the very start of neural network research it has been assumed that networks had the power to generalize. That is, if you train a network to recognize a cat using a particular set of cat photos the network will, as long as it has been trained properly, have the ability to recognize a cat photo it hasn't seen before.

Within this assumption has been the even more "obvious" assumption that if the network correctly classifies the photo of a cat as a cat then it will correctly classify a slightly perturbed version of the same photo as a cat. To create the slightly perturbed version you would simply modify each pixel value, and as long as the amount was small, then the cat photo would look exactly the same to a human - and presumably to a neural network. However, this isn't true. |

http://www.i-programmer.info/news/105-artificial-intelligence/7352-the-flaw-lurking-in-every-deep-neural-net.html

Und ausserdem:

| Dorian Aur, Stanford University hat folgendes geschrieben: |

| Biological neuroevolution and deep learning (a machine learning technique) are two different things. Many scientists still feel that everything regarding building a reliable thinking machine can be reduced to machine learning.

For a real progress in AI we will need far more http://dx.doi.org/10.13140/2.1.2286.5608 |

Trockene Fachartikel sind leider nicht so leicht bekömmlich, wie autodidaktische SciFi-Schwurbelei

—

| cortano hat folgendes geschrieben: | ||

| Die ganze Sci-Fi-ktionäre Propagandashow um deeplearning ist vermutlich hauptsächlich ein gelungener Marketing-Gag, wobei ich die enormen Fortschritte bei der Mustererkennung nicht in Abrede stellen will. Aber dafür ist GO gar kein so gutes Beispiel weil das Gewinn-Problem eher "flach" und formalisierbar ist. Das Problem war hauptsächlich der grosse ca. 10^170 Möglichkeitsraum an Positionen.

Und ich selbst finde das ganze sehr spannend, vorallem auch wenn man sich über die möglichen Einsatzgebiete Gedanken macht und auch eventueller Fehler die dann unangenehme Folgen haben.

http://www.i-programmer.info/news/105-artificial-intelligence/7352-the-flaw-lurking-in-every-deep-neural-net.html |

Nochmal: Das Go-Problem ist zwar theoretisch formalisierbar, nur nützt Dir das wegen der zu großen Anzahl der Möglichkeiten nichts,wie Du selbst bemerkst. Das bedeutet, dass der Ansatz nicht über eine Formalisierung läuft. Insofern ist der Hinweis auf die Formalisierung des Go-Problems irreführend - darauf hatte ich bereits hingewiesen.

Zu den anderen Problem: Was da beschrieben steht, stimmt für das Training in der Betrachtung 2-dimensionaler Formen.

Man ist inzwischen weiter und lässt das System unterschiedliche 2-dimensionale Ansichten zu einem dreidimensionalen Modell umrechnen - verglichen werden dann die Modelle bzw. mit diesem Modell. Das dürfte auch die Art sein, in der die Gesichtserkennungssoftware auf dem Berliner HBF funktioniert. (Dafür gibt es keinen Link, aber eine Bemerkung, die irgendeiner der Verantwortlichen in einer Reportage zu diesem Thema gemacht hat, ließ sich kaum anders interpretieren.)

3,5 Jahre, so alt die Deine verlinkte Veröffentlichung, tun ganz schön viel auf diesem Sektor. Was Du hier bringst, sind keine interessanten Nachrichten aus der Praxis, sondern Geschichten aus der fernen Vergangenheit. Halte Dich mehr an den Threadtitel.

| cortano hat folgendes geschrieben: | ||

Und ausserdem:

Trockene Fachartikel sind leider nicht so leicht bekömmlich, wie autodidaktische SciFi-Schwurbelei |

Immerhin, ist schon ein halbes Jahr jünger.

Was mich jetzt aber wirklich belustigt (nicht wegen des Inhaltes selbst, sondern wegen eines Realitätsbezugs, der nicht höher ist, als der unserer Diskussion hier - es handelt sich, wie der Auto auch selbst sagt, um Science fiction mit dem Ziel, Gelder für ein mögliches Projekt locker zu machen), ist der Inhalt:

| Zitat: |

| .... We already know from neuroelectrodynamics that meaningful information in the brain is electrically (wirelessly) read out and written fast in neurons and synapses at the molecular (protein) level during the generation of action potentials and synaptic activities. Since with training, meaningful information accumulates and is electrically integrated in the brain, one can predict, that this gradual process of training will trigger a tipping point for conscious experience to emerge in the hybrid system.

.... Currently, an active preservation of the human brain with little or no loss of information is science fiction; however, this platform will technologically open a new path. In a set-up where the real human brain can accommodate to work directly with digital computers which are able to maintain physiological homeostasis, even “afterlife” becomes possible. Such platform can create reliable premises to avoid brain death or even replace cryopreservation in order to achieve ‘immortality’. I believe that this kind of hybrid, evolving system is the future. It's a dream that can change the way we treat brain diseases or understand the nature of human consciousness ... |

Mir scheint, dass ich beim Überfliegen bereits mehr verdaut habe, als Du beim sicher intensiven Lesen.

btw: Mit diesem Link gibst Du einen Zugriff unter Deinem oder irgendjemand anders Namen auf das Researchgatenet frei, mit dem man Unsinn machen kann, der diese Zulassung für dieses Netz beschädigen kann.

—

Sinnvollerweise hast du bzgl. GO mal geschrieben dass du keine Ahnung davon hast - dabei hättest du es belassen sollen. Jetzt fanasierst du wieder weit ab von dem, auf was ich dich hinweisen wollte, etwas zusammen. Man benötigt bei GO (im Gegensatz zu Mustererkennung im realen Leben) keine vielschichtigen Topologien, aber das hast du (noch) nicht geschnallt.

| fwo hat folgendes geschrieben: |

|

Mir scheint, dass ich beim Überfliegen bereits mehr verdaut habe ... |

ja dir scheint viel - das ist mir bereits überdeutlich aufgefallen. Gratulation zur Verdauung !

Statt weiterer unqualifizierter Schwurbelei über das Alter des einen Artikels könntest du gerne mal Belege bringen, dass das dort geschilderte Problem bereits vollständig gelöst sei. Mir ist nichts davon bekannt ...

Dasselbe kannst auch in Artikeln aus 2017 lesen

| Zitat: |

| “You cannot achieve general intelligence simply by scaling up today’s deep learning techniques,” warns Chollet.

Humans only need to be told once to avoid cars. We’re equipped with the ability to generalize from just a few examples and are capable of imagining (i.e. modeling) the dire consequences of being run over. Without losing life or limb, most of us quickly learn to avoid being overrun by motor vehicles. While neural networks achieve statistically impressive results across large sample sizes, they are “individually unreliable” and often make mistakes humans would never make, such as classify a toothbrush as a baseball bat. |

Oder:

https://www.topbots.com/understanding-limits-deep-learning-artificial-intelligence/

Zuletzt bearbeitet von cortano am 20.12.2017, 14:52, insgesamt einmal bearbeitet

—

| cortano hat folgendes geschrieben: |

| ....

Statt weiterer unqualifizierter Schwurbelei über das Alter des einen Artikels könntest du gerne mal Belege bringen, dass das dort geschilderte Problem bereits vollständig gelöst sei. Mir ist nichts davon bekannt ... |

| cortano hat folgendes geschrieben: | ||

Dasselbe kannst auch in Artikeln aus 2017 lesen

https://www.topbots.com/understanding-limits-deep-learning-artificial-intelligence/ |

Das ist jetzt ein ganz anderes Thema, das hier auch kontrovers diskutiert wurde/wird, was ein hochqualifizierter Leser wie Du allerdings nicht unbedingt bemerkt.

btw: Der oben von Dir zitierte Dorian Aur vertritt eine ähnlich These wie die, gegen die Du Dich gerade wieder mit diesem Zeitungsartikel zur Wehr setzt. Du brauchst dafür auch das ResearchGate nicht zu öffnen - ich habe die entsprechenden Aussagen mit zitiert.

Außerdem wäre es schlau, wenn Du den Link aus dem Researchgatezitat entfernen würdest.

—

| fwo hat folgendes geschrieben: |

|

|

nein.

Möchtest du mit dieser Art von konstuktivem Missverständnis deine "geistige Verwandschaft" zu ähnlichen Fehlleistungen bei KI's andeuten ?

| fwo hat folgendes geschrieben: |

|

Das ist jetzt ein ganz anderes Thema ... btw: Der oben von Dir zitierte Dorian Aur vertritt eine ähnlich These wie die, gegen die Du Dich gerade wieder mit diesem Zeitungsartikel zur Wehr setzt. |

nein. Dir scheint ...

| fwo hat folgendes geschrieben: |

|

Außerdem wäre es schlau, wenn Du den Link aus dem Researchgatezitat entfernen würdest. |

https://www.google.de/search?q="dx.doi.org%2F10.13140%2F2.1.2286.5608"

—

| cortano hat folgendes geschrieben: | ||||

nein. Möchtest du mit dieser Art von konstuktivem Missverständnis deine "geistige Verwandschaft" zu ähnlichen Fehlleistungen bei KI's andeuten ?

nein. Dir scheint ... |

Kann sein, dass Du es nicht erkennst:

| Zitat: |

| Since with training, meaningful information accumulates and is electrically integrated in the brain, one can predict, that this gradual process of training will trigger a tipping point for conscious experience to emerge in the hybrid system. |

| cortano hat folgendes geschrieben: | ||

https://www.google.de/search?q="dx.doi.org%2F10.13140%2F2.1.2286.5608"  |

Hast recht. Das sah bei mir so aus, weil ich noch angemeldet war. Sollte ich natürlich besser nicht machen, weil ich den Inhalt trockener Fachartikel sowieso nicht verstehe.

—

| fwo hat folgendes geschrieben: | ||

|

Kann sein, dass Du es nicht erkennst:

|

Mühsam, mühsam ...

Du hast in "fiktional autodidaktischer" Weise aus der GO-KI "Schlüsse" gezogen, welche Dorian Aur irgendwann mal zukünftig als Ergebnisse gänzlich anderer HYBRIDER KI-Strukturen für möglich hält.

Du solltest vielleicht genauer und etwas mehr lesen als nur das Abstract. Und obwohl das ganze wissenschaftlich interessant ist, sollte man beim "Züchten biologischer Hirne" für den hybriden Gebrauch in KI's auch ein paar ethische Fragen zur Methodik stellen.

| Zitat: |

| Everyone thinks that today we are very far away from building anything remotely resembling a conscious machine. This perception might change once one understand the limits of digital computers and that our brain uses a different; more powerful "form of computation" . Indeed, “conscious machines" are science fiction if one solely uses digital computers. In this field of conscious machines the capabilities of digital systems are limited. Lately, many leaders of AI research still dream to build such systems, however far less than ever before. After decades of major problems in artificial intelligence building conscious machines became science fiction. We can solve these issues by using hybrid systems that include evolving biological structures. Once one understands that such endeavor is possible, the field of hybrid (intelligent) systems will explode. |

—

btw. ein Google Mitarbeiter nimmt Stellung zu den bekannte Fehlern bei der Mustererkennung:

| Zitat: |

| Until recently, nearly any input could fool an object recognition model. We were more surprised when object recognition worked than when it didn't. Today, object recognition algorithms have reached human performance as measured by some test set benchmarks, and we are surprised that they fail to perform as well on unnatural inputs. Adversarial examples are synthetic examples constructed by modifying real examples slightly in order to make a classifier believe they belong to the wrong class with high confidence. Rubbish class examples (such as fooling images) are pathological examples that the model assigns to some class with high confidence even though they should not belong to any class. |

https://www.kdnuggets.com/2015/07/deep-learning-adversarial-examples-misconceptions.html

output generated using printer-friendly topic mod. Alle Zeiten sind GMT + 1 Stunde

Powered by phpBB © 2001, 2005 phpBB Group